HyperAgent Competitors 2026: Wer spielt in derselben Liga – und warum Globster verdächtig ähnlich aussieht

TL;DR: „HyperAgent, Globster und Manus spielen oberflächlich in derselben Liga – persönliche Multi-Channel-Agenten mit Skills und Triggern. Unter der Haube unterscheiden sie sich massiv: HyperAgent setzt auf Fleet Management & Eval, Globster auf OpenClaw + NemoClaw-Runtime, Manus auf End-to-End-Autonomie, Lindy auf Workflow-Templates, Anthropic auf eine vollständig managed Runtime."

— Till FreitagDisclosure: Wir sind Teil der Closed Beta von HyperAgent und sehen die Plattform aus der Praxis. Diesen Artikel haben wir trotzdem so neutral wie möglich aufgesetzt – inklusive der Stellen, an denen Wettbewerber das bessere Angebot haben.

In 30 Sekunden

- HyperAgent = Fleet Management + erlernbare Skills + LLM-as-Judge Eval. Stark für Teams, die 5+ Agent-Rollen produktiv betreiben wollen.

- Globster = persönliche Agenten in 2 Minuten, gebaut auf OpenClaw, abgesichert durch NemoClaw. Interface verdächtig ähnlich zu HyperAgent.

- Manus AI = autonomer Solo-Agent für End-to-End-Recherche und -Ausführung. Kein Fleet, dafür hohe Single-Task-Tiefe.

- Lindy = klassische Workflow-Automation mit Agent-Vokabular. Stark bei vorgefertigten Templates, schwach bei echter Autonomie.

- Claude Managed Agents = Anthropic baut die Runtime selbst, gehosteter Stack statt offener Architektur.

- monday agent labs = doppelt am Tisch: einmal als Globster-Macher, einmal als monday-AI im Workspace.

Niemand davon ist „der HyperAgent-Killer". Es sind unterschiedliche Antworten auf dieselbe Frage: Wie macht man Agenten produktiv einsetzbar?

Warum dieser Artikel jetzt

Als wir HyperAgent reviewt haben (März 2026), war die Closed Beta eine Wette: Skills + Fleet + Eval als Differenzierung. Sechs Wochen später ist klar – die Wette teilt sich der Markt mit anderen.

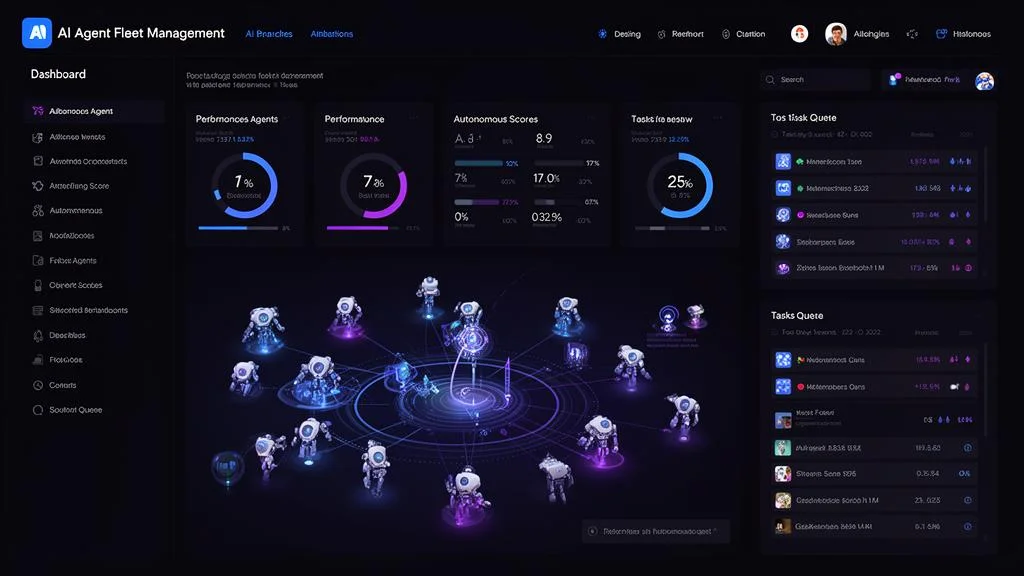

Besonders auffällig: Globster. Wer beide Interfaces nebeneinander öffnet, sieht es sofort:

- Sidebar mit „Skills", „Roles", „Triggers"

- Channel-Connectoren in der Mitte (Gmail, Slack, GitHub, Calendar)

- Modell-Auswahl pro Rolle (Claude, Gemini, Grok, Qwen)

- Credits-basiertes Pricing statt Sitze

Das ist kein Zufall. Beide bedienen denselben mentalen Modellraum: Agent als deploybare Rolle, nicht als Chat-Fenster. Der Unterschied liegt in der Schicht darunter – und genau die entscheidet bei Enterprise-Deployments.

Die fünf Mitspieler im Überblick

| Plattform | Kern-These | Architektur-Layer | Zielgruppe | Pricing-Modell |

|---|---|---|---|---|

| HyperAgent | Skills + Fleet + Eval als Operating System | Proprietär, Multi-Modell | Teams mit 5+ Agent-Rollen | Noch nicht öffentlich (Early Access) |

| Globster | Persönliche Agenten in 2 Minuten | OpenClaw + NVIDIA NemoClaw | Solo-Power-User & kleine Teams | Credits ab 29 USD/Monat |

| Manus AI | Autonomer End-to-End-Solist | Proprietär, agentic | Recherche, Single-Task-Tiefe | Credits ab 0 USD |

| Lindy | Workflow-Templates mit Agent-Schicht | 3.000+ Integrationen | KMU & Workflow-Builder | Ab 49 USD/Monat |

| Claude Managed Agents | Vollständig managed Runtime | Anthropic-Stack, Sandbox | Enterprise mit Security-Fokus | Anthropic Enterprise-Tier |

| monday agent labs (im Workspace) | Agent als Erweiterung des Boards | monday-Cloud | Bestehende monday-Kunden | Add-on im monday-Plan |

Wo die wirklichen Unterschiede liegen

1. Interface-Ähnlichkeit ≠ Architektur-Ähnlichkeit

HyperAgent und Globster sehen sich verdächtig ähnlich. Das ist kein Plagiat, sondern Konvergenz auf ein UI-Pattern, das funktioniert: Skills-Sidebar, Channel-Connectoren in der Mitte, Trigger und Budgets im Kontext der Rolle. Wer das Pattern einmal gesehen hat, baut es nach. Punkt.

Unter der Haube trennen sich aber die Wege:

- HyperAgent ist ein proprietärer Stack mit eigener Skill-Engine und Eval-Pipeline. Closed-Source, dafür eng integriert.

- Globster baut auf OpenClaw (offene Agent-Architektur) und betreibt das Ganze auf NVIDIAs NemoClaw-Runtime. Open-Core mit Container-Isolation.

Wer Lock-in vermeiden will, geht in Richtung Globster. Wer Tiefe und Eval-Disziplin braucht, bleibt bei HyperAgent.

2. Fleet vs. Persönlicher Agent

Das ist die strategische Trennlinie:

- HyperAgent denkt in Flotten – mehrere Rollen, koordiniert, mit Hand-off-Verträgen und Concurrency-Limits (siehe Field Notes #3).

- Globster denkt in einem Agent pro Person – dein persönlicher Assistent, der Mail, Kalender und Slack im Griff hat.

Beide Modelle sind valide. Aber: Wer ein Sales-Team mit 12 Agenten orchestrieren will, kommt mit „ein Agent pro Person" nicht weit. Und wer als Einzelperson schnell Inbox-Triage will, baut sich kein Fleet-Management.

3. Modell-Strategie: Multi vs. Locked

| Plattform | Modell-Wahl |

|---|---|

| HyperAgent | Multi-Model-Routing (GPT, Claude, Gemini) – pro Skill konfigurierbar |

| Globster | Multi-Model (Claude, Gemini, Grok, Qwen) – pro Agent wählbar |

| Manus AI | Eigene Modell-Mischung, intransparent |

| Lindy | OpenAI-zentriert, Claude als Option |

| Claude Managed Agents | Anthropic-only |

| monday agent labs (Workspace) | monday AI proprietär |

Die spannende Beobachtung: Die modernen Plattformen geben die Modell-Wahl an die Nutzer:innen zurück. Das ist die direkte Konsequenz aus Token Economics – wer Kosten optimieren will, braucht das richtige Modell pro Task, nicht „One model fits all".

4. Sicherheit & Compliance

Hier wird es ernst:

- Globster: NemoClaw-Runtime von NVIDIA – Container-Isolation, Netzwerk-Policies, optional Privacy Router. Architektonisch der ambitionierteste Ansatz.

- HyperAgent: Eigene Sandbox, Permission-Scopes pro Rolle, Eval-Audit. Solide, aber proprietär – tiefe Audits brauchen NDA.

- Claude Managed Agents: Vollständig in Anthropics Stack – maximale Kontrolle für Anthropic, weniger für Customer.

- Manus & Lindy: Standard SaaS-Sicherheit, kein dedizierter Agent-Sandbox-Layer dokumentiert.

Wer in DACH/EU plant, sollte den Agent-Sandboxing-Vergleich und unsere Governance-Leitplanken durchgehen, bevor er sich festlegt.

5. Pricing-Realität

- Globster: 29/79/199 USD pro Monat, credits-basiert, 7-Tage-Trial. Transparent.

- Lindy: ab 49 USD/Monat, Sitz-Logik mit Task-Limits. Transparent.

- Manus: Credits ab 0, Pay-as-you-go. Transparent für Solo-Use.

- HyperAgent: Noch nicht öffentlich. Enterprise-Pricing erwartet.

- Claude Managed Agents: Enterprise-Tier von Anthropic, kein öffentliches SKU.

Übersetzt: Wer heute starten will, kommt bei Globster, Lindy oder Manus schneller in die Karte als bei HyperAgent oder Claude Managed. Das ist kein Qualitätsurteil, nur ein Time-to-Value-Fakt.

Pricing-Vergleich: Solo vs. Team vs. Enterprise

Konkreter aufgeschlüsselt – mit Modell (Credits vs. Seats), möglichen Zusatzkosten und einer Heuristik für 1.000 Runs/Tasks pro Monat. Wichtig: Die Run-Kosten sind Schätzungen aus der Praxis. Ein „Run" = ein Agent-Task von Trigger bis Abschluss, durchschnittlich 5–15 LLM-Calls + ggf. Tool-Calls. Browser-Heavy-Runs liegen am oberen Ende.

| Anbieter | Solo (1 User) | Team (5–20 User) | Enterprise (20+ / SSO) | Modell | Zusatzkosten | ~ Kosten / 1.000 Runs |

|---|---|---|---|---|---|---|

| HyperAgent | n/a (Closed Beta) | Auf Anfrage | Custom, Pricing per Sales | Hybrid: Seats + Skill-Runs | Eval-Pipeline-Kosten, ggf. dedizierte Modelle | ~ 200–500 USD (geschätzt, Multi-Modell) |

| Globster | 29 USD (2.900 Credits) | 79 USD Pro / 199 USD Business | „Business+": auf Anfrage | Credits pro Run | Modell-Aufpreis (Claude Opus, Gemini Ultra), zusätzliche Credit-Packs | ~ 80–250 USD (1 Credit ≈ 1 leichter Run) |

| Manus AI | 0 USD (Free Credits), Pay-as-you-go | n/a (Solo-Tool) | n/a | Credits pro Task | Höhere Modelle und Tool-Use brennen Credits schneller | ~ 100–400 USD (stark task-abhängig) |

| Lindy | 49 USD Starter | 199 USD Pro / 599 USD Business | Custom Enterprise | Seats + Task-Limits | Über-Limit-Tasks, Premium-Integrationen | ~ 50–150 USD (im Plan inkludiert, Overage extra) |

| Claude Managed Agents | n/a | n/a | Anthropic Enterprise-Tier | Token-basiert + Plattform-Fee | Premium-Support, dedizierte Kapazität | ~ 300–800 USD (Token-getrieben, Sonnet/Opus-Mix) |

| monday agent labs (Workspace) | im monday-Plan inkl. | im monday-Plan inkl. | im monday-Enterprise | Add-on auf monday-Sitze | AI-Credits-Pack on top | ~ 50–200 USD (je nach AI-Pack) |

Wie diese Zahlen lesen:

- Credits ≠ Tasks: Bei Globster verbraucht ein leichter E-Mail-Triage-Run 1–3 Credits, ein Browser-Webflow mit Vision schnell 20–50.

- Seats ≠ Skalierung: Lindy mit Sitz-Logik wird teuer, wenn 50 Personen einen Agent triggern – aber günstig, wenn 5 Personen 10.000 Tasks fahren.

- Token-basiert (Claude Managed) = höchste Vorhersagbarkeit pro Task, höchste Volatilität bei Modell-Wechsel.

- Versteckte Kosten überall: Eval-Pipelines (HyperAgent), Premium-Modelle (Globster), Overage-Tasks (Lindy), dedizierte Kapazität (Claude). Plane mit +30 % Buffer über das Listenpreis-SKU hinaus.

Wer das systematisch durchrechnen will: unser Token-Economics-Artikel liefert die Formel hinter den Schätzungen.

6. Browser- & UI-Automation: Globster vs. HyperAgent in der Praxis

Die spannendste – und am wenigsten dokumentierte – Trennlinie. Beide Plattformen werben mit „Real-World Actions". Schaut man hin, machen sie es sehr unterschiedlich.

Wie Globster Webflows ausführt

Globster fährt einen headless Chromium pro Agent-Run in einem NemoClaw-Container hoch. Der Agent sieht die Seite als gerendertes DOM + Screenshot, navigiert via Vision-Modell-Anweisungen („klicke das blaue Login-Feld") und führt Skripte über Playwright-ähnliche Bindings aus.

Typischer Ablauf für eine Formular-Füllung:

- Trigger: Slack-Befehl

/agent fülle das Demo-Formular auf example.com mit Daten aus letzter Mail - Capture: Agent öffnet die Seite, macht Screenshot, parst DOM

- Plan: Vision-Modell mappt Felder → Daten aus Memory/Mail

- Act: Sequentielles

fill+clicküber Browser-Tool - Verify: Screenshot nach Submit, Vergleich gegen erwartetes Confirmation-Element

Stärken: schnelle Setup-Zeit, viele Sites „funktionieren einfach", Login-Sessions persistieren im Container.

Wie HyperAgent Webflows ausführt

HyperAgent hat einen Browser als Tool – aber das eigentliche Asset ist der Skill, der den Browser steuert. Statt jedes Mal das Vision-Modell entscheiden zu lassen, codifiziert ein Skill den deterministischen Pfad: Selektoren, Wartezeiten, Recovery-Schritte.

Typischer Ablauf für dieselbe Formular-Füllung:

- Skill-Lookup: „Demo-Formular example.com" existiert als getesteter Skill

- Hydrate: Skill liest Daten-Kontext aus Hand-off-Vertrag (z. B. von einer anderen Rolle)

- Execute: deterministischer Playwright-Pfad mit Eval-Hooks an jedem Schritt

- Eval: LLM-as-Judge prüft, ob der Skill korrekt durchlief – fließt in den Skill-Score

- Improve: bei Fail wird ein Verbesserungs-Vorschlag erzeugt, Owner reviewt

Stärken: reproduzierbar, auditierbar, skaliert in der Fleet, Fehler-Pattern werden zu Skill-Updates.

Direkter Vergleich

| Dimension | Globster | HyperAgent |

|---|---|---|

| Browser-Engine | Headless Chromium pro Run, im NemoClaw-Container | Headless Browser als Skill-Tool, sandboxed |

| Steuerungs-Modus | Vision-First, Agent entscheidet pro Schritt | Skill-First, deterministischer Pfad mit Eval |

| Login-Persistenz | Session pro Agent, isoliert | Session pro Skill-Run, Credentials via Vault |

| Formular-Füllung | Generisch, „klappt meistens" | Skill-codifiziert, „klappt reproduzierbar" |

| Multi-Step-Webflow | Möglich, aber jeder Run neu interpretiert | Hand-off-Vertrag zwischen Skills, Fleet-fähig |

| Captcha & MFA | Fail oder Human-in-the-Loop via Slack | Fail mit Recovery-Hook, Owner-Notification |

| Audit-Trail | Screenshots + Run-Log | Screenshots + Run-Log + Eval-Score + Skill-Diff |

| Best Use Case | Ad-hoc-Webtasks, persönliche Inbox | Wiederkehrende Webflows in Fleet-Kontext |

Die harten Grenzen (für beide)

Egal welche Plattform – diese Grenzen sind real:

- Anti-Bot-Schutz: Cloudflare Turnstile, hCaptcha, fingerprintbasierte Detection. Beide failen oder brauchen externe Solver, was rechtlich grau ist.

- OAuth-Flows mit MFA: SMS/Authenticator-Codes brechen jeden autonomen Flow. Lösung: Session-Reuse oder Human-in-the-Loop.

- Dynamische SPAs ohne stabile Selektoren: React-Apps mit

class="css-1a2b3c"– Vision-First (Globster) ist hier robuster, Skill-First (HyperAgent) braucht häufige Skill-Updates. - Rate Limits & Bans: Wer 200 Form-Submits pro Stunde fährt, fliegt vom Ziel-Service. Beide Plattformen haben kein eingebautes Soft-Throttling.

- Rechtliches: ToS vieler Sites verbieten automatisierten Zugriff. Browser-Automation ohne API-Vertrag ist immer ein Risiko.

- Kosten-Eskalation: Vision-Calls pro Schritt summieren sich. Ein Globster-Webflow mit 30 Schritten kann 5–10x mehr Tokens verbrauchen als ein API-Call. Pflichtlektüre dazu: Token Economics.

Praxis-Empfehlung

- Wenn API existiert → API nutzen, kein Browser-Agent. Punkt.

- Wenn Webflow ad hoc & einmalig → Globster (oder Manus für reine Recherche).

- Wenn Webflow wiederkehrend & Audit-Pflicht → HyperAgent als Skill, mit Eval-Score-Tracking.

- Wenn Captcha/MFA im Spiel → keine der beiden, sondern RPA-Tooling mit Human-in-the-Loop oder direkter API-Vertrag.

Browser-Automation ist 2026 immer noch der am häufigsten überschätzte Agent-Use-Case. Beide Plattformen können es – aber „können" und „sollten" sind hier nicht dasselbe.

Drei ehrliche Wahrheiten

Wahrheit 1: Globster ist der direkteste HyperAgent-Wettbewerber – und gleichzeitig keiner

Direkt im Interface, Skill-Modell und Channel-Coverage. Indirekt in der Zielgruppe: Globster ist „mein persönlicher Agent", HyperAgent ist „die Agent-Plattform meines Teams". Wer beide Use Cases hat, braucht beide. Wer nur eines hat, sollte sich entscheiden.

Wahrheit 2: Lindy ist die unterschätzte Workflow-Brücke

Lindy verkauft sich als „Agent", ist aber zu großen Teilen klassische Workflow-Automation mit Agent-Vokabular. Das ist kein Vorwurf – im Gegenteil: Für 60 % aller B2B-Use-Cases reicht das. Wer bisher mit n8n oder Zapier baut und einen sanften Sprung will, ist bei Lindy gut aufgehoben.

Wahrheit 3: Anthropic baut die Runtime, weil Open-Source vs. Managed die nächste Schlacht wird

Claude Managed Agents ist Anthropics Wette: Die Runtime selbst zu kontrollieren, nicht nur das Modell. Das ist die strategische Antwort auf Globster + NemoClaw – und es wird die nächste Frage für Enterprise-Käufer:innen: Open-Architecture mit Multi-Vendor (Globster-Pfad) oder Managed-Stack mit einem Provider (Anthropic-Pfad)?

Wer wählt was?

| Wenn du... | Wähle... |

|---|---|

| ...ein Team mit 5+ Agent-Rollen orchestrieren willst | HyperAgent |

| ...persönliche Inbox/Kalender-Triage in 2 Min willst | Globster |

| ...autonome Recherchen ohne Babysitting brauchst | Manus AI |

| ...heute starten und n8n/Zapier ablösen willst | Lindy |

| ...maximale Anthropic-Integration mit Enterprise-Kontrolle willst | Claude Managed Agents |

| ...bereits monday.com nutzt und Agenten am Board brauchst | monday agent labs (Workspace-AI) |

Das ist keine erschöpfende Matrix – aber sie zeigt: Es gibt keinen universellen Sieger. Es gibt unterschiedliche Use Cases mit unterschiedlich passenden Plattformen.

Was wir nicht wissen (noch)

- HyperAgent-Pricing – Enterprise-Tier? Pay-per-Eval? Pay-per-Skill?

- Globster-Skalierung – läuft NemoClaw stabil unter realer Last (250k+ potentielle monday-Kunden)?

- Manus-Roadmap – kommt Multi-Agent-Fleet, oder bleibt es Solo-Player?

- Anthropic-Coverage – wann öffnet sich Claude Managed über die Top-Enterprise-Accounts hinaus?

- monday agent labs – wie weit entkoppelt sich Globster langfristig vom monday-Mutterprodukt?

Wir tracken alle fünf weiter und schreiben Field Notes, sobald sich was Substanzielles bewegt.

Security-Checkliste: 5 Minuten pro Plattform

Bevor du ernsthaft pilotierst – egal ob HyperAgent, Globster, Manus, Lindy, Claude Managed oder monday agent labs – arbeite diese Checkliste durch. Vier Bereiche, jeweils 4–5 Fragen, jede mit klarer Pass/Fail-Antwort. Wenn mehr als drei Fragen mit „weiß ich nicht" enden, ist die Plattform für dein Szenario nicht audit-fähig.

1. Sandbox & Isolation (≈ 90 Sek)

- Wo läuft der Agent-Run? Container, VM, WASM, Kernel-Sandbox – exakter Layer dokumentiert?

- Ist jeder Run isoliert oder teilen sich Runs einen persistenten Worker?

- Wie ist Netzwerk-Egress beschränkt? Allowlist pro Rolle, Default-Deny, oder offen?

- Was passiert mit Browser-Sessions nach dem Run? Verworfen, persistiert, geteilt?

- Welche OS-Prozesse darf der Agent starten? Shell-Zugriff, Code-Execution-Limits?

→ Tiefere Einordnung im Agent-Sandboxing-Vergleich.

2. Permission-Scopes (≈ 60 Sek)

- Granularität pro Connector: Reicht „Gmail" oder kannst du Labels/Absender filtern?

- Read vs. Write getrennt pro Tool – oder All-or-Nothing-Token?

- Owner-Approval für sensible Aktionen (Send Mail, External API Call)?

- Token-Rotation automatisch oder Owner-Verantwortung?

- Revoke-Pfad definiert – wie schnell kannst du einen kompromittierten Agent stoppen?

3. Datenfluss (≈ 90 Sek)

- Welche Modelle werden tatsächlich gerufen? US-Hosting, EU-Hosting, On-Prem?

- Wird Input/Output für Modell-Training verwendet? Opt-out konfigurierbar?

- Logging-Standort – wo liegen Run-Logs, Screenshots, Eval-Ergebnisse?

- Privacy Router vorhanden? Können sensible Felder lokal/günstiger gerouted werden? Siehe Privacy Router Guide.

- Daten-Residenz vertraglich zusicherbar (DPA, AVV, Standardvertragsklauseln)?

4. Audit-Fähigkeit (≈ 60 Sek)

- Vollständiger Run-Log mit Inputs, Tool-Calls, Outputs – exportierbar als JSON/CSV?

- Screenshots/Recordings von Browser-Runs erhalten und durchsuchbar?

- Eval-Score historisch nachvollziehbar pro Skill/Rolle – inkl. Regression-Detection?

- Wer hat wann was geändert an einer Rolle/einem Skill (Audit-Trail)?

- SIEM-/Webhook-Export der Audit-Events in dein zentrales Log-System?

Bewertungs-Heuristik

| Bestandene Fragen | Verdict |

|---|---|

| 17–19 von 19 | Produktionsreif für regulierte Use Cases |

| 13–16 | Pilotier-fähig, plane Restrisiken aktiv |

| 9–12 | Nur für interne, nicht-sensible Use Cases |

| ≤ 8 | Stop. Nicht ohne dedizierten Security-Review |

Wichtig: Diese Checkliste ersetzt keinen formalen Security-Review oder DPIA. Sie ist ein Schnelltest, um zu erkennen, bei welcher Plattform du den Aufwand überhaupt rechtfertigen kannst. Ergänzend lohnen sich unsere Governance-Leitplanken für autonome KI-Agenten.

Mapping auf Compliance-Frameworks

Damit die Checkliste nicht im luftleeren Raum hängt, hier die Brücke zu den drei Frameworks, die in DACH-Audits am häufigsten auf den Tisch kommen. Jede Checklisten-Frage adressiert mindestens eine konkrete Anforderung.

| Checklisten-Bereich | DSGVO / DPA | SOC 2 (Trust Services Criteria) | ISO/IEC 27001:2022 (Annex A) |

|---|---|---|---|

| Sandbox & Isolation | Art. 32 (Sicherheit der Verarbeitung), Art. 25 (Privacy by Design) | CC6.1 (Logical Access), CC6.6 (System Boundaries) | A.8.20 (Network Security), A.8.22 (Segregation of Networks) |

| Permission-Scopes | Art. 5 Abs. 1 lit. c (Datenminimierung), Art. 32 (Zugriffskontrolle) | CC6.1 (Logical Access), CC6.3 (Role-based Access) | A.5.15 (Access Control), A.8.2 (Privileged Access Rights) |

| Datenfluss | Art. 28 (Auftragsverarbeitung / DPA), Art. 44–49 (Drittlandtransfer, SCC), Art. 30 (Verarbeitungsverzeichnis) | CC6.7 (Data Transmission), C1.1 (Confidentiality) | A.5.34 (Privacy & PII), A.5.14 (Information Transfer), A.8.10 (Information Deletion) |

| Audit-Fähigkeit | Art. 5 Abs. 2 (Rechenschaftspflicht), Art. 30 (Verzeichnis), Art. 33 (Meldepflicht) | CC4.1 (Monitoring), CC7.2 (Anomalies & Incidents) | A.8.15 (Logging), A.8.16 (Monitoring Activities), A.5.25 (Assessment of Events) |

Praxis-Hinweise:

- DSGVO/DPA: Ohne unterzeichneten AVV nach Art. 28 DSGVO kein Produktiv-Einsatz mit Personenbezug. Bei US-Hosting zwingend SCC + Transfer Impact Assessment (TIA). Vorlagen direkt vom EDSA oder LfDI BW.

- SOC 2: Frage den Anbieter nach dem aktuellen Type-II-Report (nicht Type I, nicht „in progress"). Letzte 12 Monate, gleicher Scope wie dein Use Case. Bezugsquelle: meist Trust Center des Anbieters oder unter NDA.

- ISO 27001: Zertifikat von akkreditierter Stelle (DAkkS in DE), Geltungsbereich (Statement of Applicability) muss die genutzte Service-Komponente abdecken – sonst wertlos. Standard und Annex A: ISO/IEC 27001:2022.

- EU AI Act: Agenten-Plattformen können je nach Use Case unter „Hochrisiko-KI" fallen (z. B. HR, Kreditvergabe). Frühzeitig prüfen – Übersicht im offiziellen AI-Act-Text.

Die Mapping-Tabelle ist bewusst grob gehalten. Für eine vollständige Kontrollen-Zuordnung empfehlen wir den Abgleich mit dem hauseigenen ISMS oder eine externe Begleitung. Unsere Governance-Leitplanken und der Agent-Sandboxing-Vergleich liefern die methodischen Bausteine dazu.

Fazit

HyperAgent hat keinen Killer – aber ernsthafte Konkurrenz. Die ehrliche Lesart 2026:

- Skills + Fleet + Eval ist nicht mehr alleinstellend. Globster und Anthropic ziehen architektonisch nach.

- Interface-Patterns konvergieren – wer ein gutes Agent-UI sieht, sieht es bald überall.

- Der Differentiator wandert in die Runtime-Schicht – Sandbox, Permission-Modell, Eval-Disziplin entscheiden, nicht das nächste Skill.

Für Teams im DACH-Raum heißt das: Nicht auf „die eine Plattform" warten. Pilot mit der Plattform, die zu deinem Use Case passt – und so bauen, dass ein Wechsel später möglich bleibt. Context Engineering ist der portable Teil. Das Tool drumrum ist es nicht.

→ HyperAgent Tool-Übersicht → HyperAgent Review 2026 → HyperAgent Field Notes #1: Setup & erster Skill → HyperAgent Field Notes #2: Vom Skill zur deploybaren Rolle → HyperAgent Field Notes #3: Von der Rolle zur Fleet → Globster: monday.com bringt persönliche KI-Agenten → Claude Managed Agents: Anthropics Griff nach der Agent-Runtime → Agent Sandboxing: Container vs. WASM vs. Kernel → Die 5 Bausteine eines KI-Agenten → Agentic Engineering verstehen → Kontakt aufnehmen

Häufig gestellte Fragen

Schnelle Antworten zu Globster vs. HyperAgent, Eval, Fleet vs. Solo, Pricing und Browser-Automation.