Lokale LLMs mit OpenClaw: Ollama, Llama 3.3, Qwen 3.5 & MiniMax M2.5 im Praxistest

TL;DR: „Lokale LLMs mit OpenClaw sind 2026 produktionsreif. Llama 3.3 ist der Allrounder, Qwen 3.5 der Effizienz-Champion, MiniMax M2.5 das Coding-Monster. Alle laufen via Ollama – ohne Cloud, ohne Kosten, ohne Datenschutz-Kompromisse."

— Till FreitagWarum lokale LLMs?

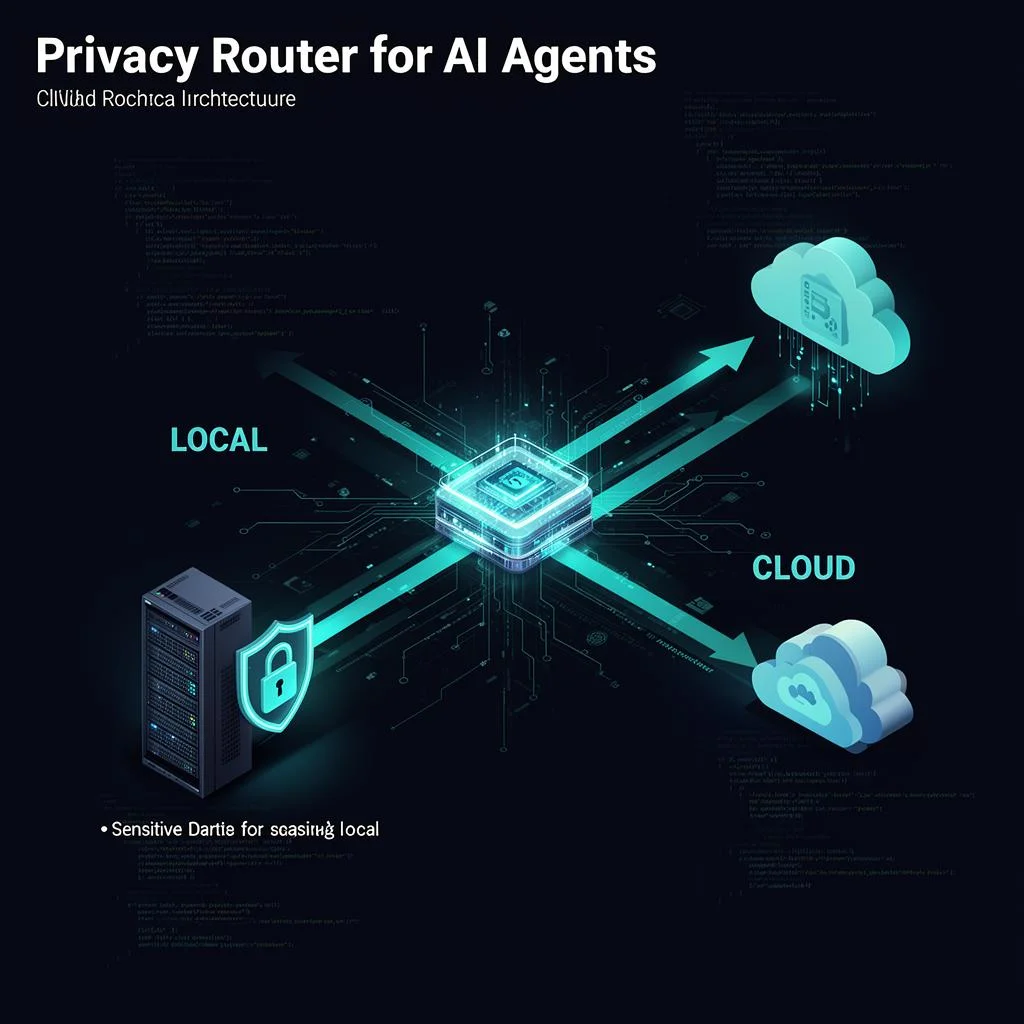

Cloud-APIs sind bequem – aber sie haben drei Probleme:

- Kosten: GPT-4o kostet ~$15 pro Million Output-Tokens. Bei intensiver Agent-Nutzung sind $300–700/Monat realistisch.

- Datenschutz: Jeder API-Call sendet Daten an US-Server. DSGVO-konform? Nur mit Auftragsverarbeitungsvertrag und Risikoabwägung.

- Abhängigkeit: API down? Rate-Limit erreicht? Dein Agent steht still.

Lokale LLMs lösen alle drei Probleme. Und 2026 sind sie endlich gut genug für den produktiven Einsatz.

30-Sekunden-Version: Ollama installieren, Modell pullen, OpenClaw verbinden – fertig. Kein API-Key, keine Kosten pro Token, keine Daten an Dritte.

Die Kandidaten

Wir haben vier Modelle getestet, die sich für den lokalen Einsatz mit OpenClaw eignen:

| Modell | Anbieter | Parameter | Aktive Params | Kontext | Architektur |

|---|---|---|---|---|---|

| Llama 3.3 | Meta | 70B | 70B | 128K | Dense |

| Qwen 3.5 27B | Alibaba | 27B | 27B | 256K | Dense |

| Qwen 3.5 35B-A3B | Alibaba | 35B | 3B | 256K | MoE |

| MiniMax M2.5 | MiniMax | 230B | 10B | 200K | MoE |

Was bedeutet MoE?

Mixture of Experts (MoE) ist das Geheimnis hinter den neuen Modellen: Obwohl das Modell 230B Parameter hat, werden pro Token nur 10B aktiviert. Das Ergebnis: GPT-4-Qualität bei einem Bruchteil der Rechenleistung.

Installation via Ollama

Alle Modelle lassen sich mit einem Befehl herunterladen:

# Ollama installieren (falls noch nicht geschehen)

curl -fsSL https://ollama.com/install.sh | sh

# Modelle pullen

ollama pull llama3.3 # 40 GB – braucht 48 GB RAM

ollama pull qwen3.5:27b # 16 GB – läuft auf 22 GB RAM

ollama pull qwen3.5:35b # 20 GB – nur 3B aktiv (MoE)

ollama pull minimax-m2.5 # 101 GB (3-bit) – braucht 128 GB RAMMit OpenClaw verbinden

openclaw config set models.providers.ollama.apiKey "ollama-local"

openclaw config set agents.defaults.model.primary "ollama/qwen3.5:27b"Performance-Benchmarks

Getestet auf Apple M3 Max (128 GB RAM) und NVIDIA RTX 4090 (24 GB VRAM):

Geschwindigkeit (Tokens/Sekunde)

| Modell | M3 Max (128 GB) | RTX 4090 (24 GB) | Bemerkung |

|---|---|---|---|

| Llama 3.3 70B | ~18 t/s | ~25 t/s | Braucht viel RAM |

| Qwen 3.5 27B | ~35 t/s | ~55 t/s | Bester Speed/Qualität-Trade-off |

| Qwen 3.5 35B-A3B | ~60 t/s | ~80 t/s | MoE-Turbo: nur 3B aktiv |

| MiniMax M2.5 | ~15 t/s | Nicht möglich* | Braucht >24 GB VRAM |

*MiniMax M2.5 benötigt mindestens 64 GB RAM oder Multi-GPU-Setup.

Qualität (Benchmarks)

| Modell | MMLU-Pro | HumanEval | SWE-Bench | Agentic Use |

|---|---|---|---|---|

| Llama 3.3 70B | 68.9 | 82.5 | – | ★★★★☆ |

| Qwen 3.5 27B | 71.2 | 85.1 | – | ★★★★☆ |

| Qwen 3.5 35B-A3B | 69.5 | 83.8 | – | ★★★★☆ |

| MiniMax M2.5 | 74.1 | 89.3 | 80.2% | ★★★★★ |

Ergebnis: Qwen 3.5 27B bietet den besten Trade-off aus Geschwindigkeit, Qualität und Ressourcenverbrauch. MiniMax M2.5 ist das stärkste Modell, braucht aber erheblich mehr Hardware.

Kosten-Vergleich: Cloud vs. Lokal

Cloud-Kosten (pro Monat, geschätzt bei 50M Tokens)

| Anbieter | Modell | Input | Output | Gesamt/Monat |

|---|---|---|---|---|

| OpenAI | GPT-4o | $2.50/1M | $10/1M | ~$300 |

| Anthropic | Claude 3.5 Sonnet | $3/1M | $15/1M | ~$400 |

| OpenAI | GPT-4o mini | $0.15/1M | $0.60/1M | ~$20 |

Lokale Kosten (einmalig + Strom)

| Setup | Hardware | Einmalig | Strom/Monat | Break-Even |

|---|---|---|---|---|

| Mac mini M4 Pro | 48 GB RAM | ~2.200 € | ~15 € | 7–8 Monate |

| Mac Studio M3 Max | 128 GB RAM | ~4.500 € | ~25 € | 12–15 Monate |

| Linux Server + RTX 4090 | 64 GB RAM | ~3.000 € | ~40 € | 8–10 Monate |

| Raspberry Pi 5 | 8 GB RAM | ~120 € | ~5 € | 1 Monat |

Fazit: Ab ~8 Monaten ist Self-Hosting günstiger als jede Cloud-API. Bei intensiver Nutzung (>100M Tokens/Monat) sogar nach 3–4 Monaten.

Offline-Szenarien

Lokale LLMs haben einen entscheidenden Vorteil, den keine Cloud bieten kann: Sie funktionieren ohne Internet.

Wann ist Offline relevant?

- Unterwegs: Im Zug, im Flugzeug, auf Baustellen – überall dort, wo kein stabiles Internet verfügbar ist

- Air-Gapped Umgebungen: Sicherheitskritische Infrastruktur (Behörden, Militär, Gesundheitswesen)

- Edge-Deployments: IoT-Gateways, Fabrikhallen, Außenstandorte

- Ausfallsicherheit: Wenn die Cloud-API ausfällt, läuft dein Agent trotzdem weiter

Empfohlenes Offline-Setup

# Kompaktes Modell für Offline-Einsatz auf schwächerer Hardware

ollama pull qwen3.5:35b # MoE: nur 3B aktiv, läuft auf 22 GB RAM

# Für Raspberry Pi / Edge-Devices

ollama pull phi-3:mini # 3.8B Parameter, 4 GB RAMOpenClaw Offline-Config

{

"agents": {

"defaults": {

"model": {

"primary": "ollama/qwen3.5:35b",

"fallbacks": ["ollama/phi-3:mini"]

}

}

},

"network": {

"offline_mode": true,

"web_search": false

}

}Welches Modell für welchen Use Case?

| Use Case | Empfohlenes Modell | Warum |

|---|---|---|

| E-Mail-Triage | Qwen 3.5 27B | Schnell, 256K Kontext für lange Threads |

| Code-Analyse | MiniMax M2.5 | SWE-Bench 80.2%, bestes Coding-Modell |

| Schnelle Antworten | Qwen 3.5 35B-A3B | MoE: 60+ t/s auf Apple Silicon |

| Zusammenfassungen | Llama 3.3 70B | Solide Qualität, breites Sprachverständnis |

| Offline / Edge | Qwen 3.5 35B-A3B | MoE + 256K Kontext bei niedrigem Verbrauch |

| Raspberry Pi | Phi-3 Mini | Einziges Modell unter 4 GB RAM |

Qwen 3.5: Der Newcomer im Detail

Alibabas Qwen 3.5 verdient besondere Aufmerksamkeit. Die Modell-Familie bringt 2026 einige Premieren:

- 256K Kontext: Doppelt so viel wie Llama 3.3 – ideal für lange E-Mail-Threads oder Dokumenten-Analyse

- 201 Sprachen: Echtes Multilingual-Modell, perfekt für internationale Teams

- Multimodal: Die 27B- und 122B-Varianten können auch Bilder verarbeiten

- Thinking-Mode: Eingebautes Chain-of-Thought-Reasoning, zuschaltbar per Parameter

- MoE-Varianten: 35B-A3B aktiviert nur 3B Parameter – läuft auf einem MacBook Air

# Thinking-Mode aktivieren (für komplexe Aufgaben)

ollama run qwen3.5:27b --thinkingMiniMax M2.5: Das Coding-Monster

MiniMax M2.5 aus Shanghai hat die AI-Community überrascht:

- SWE-Bench Verified: 80.2% – auf Augenhöhe mit Claude Opus 4.6

- 230B Parameter, 10B aktiv: MoE-Architektur für Effizienz

- Agentic Design: Nativ für Tool-Calling und Search optimiert

- 200K Kontext: Genug für komplette Codebases

Der Haken: Du brauchst mindestens 64 GB RAM (besser 128 GB) für das 3-bit-quantisierte Modell. Aber wenn du die Hardware hast, bekommst du ein Modell, das mit den besten Cloud-APIs mithalten kann – zum Nulltarif.

# MiniMax M2.5 via Ollama (benötigt viel RAM!)

ollama pull minimax-m2.5

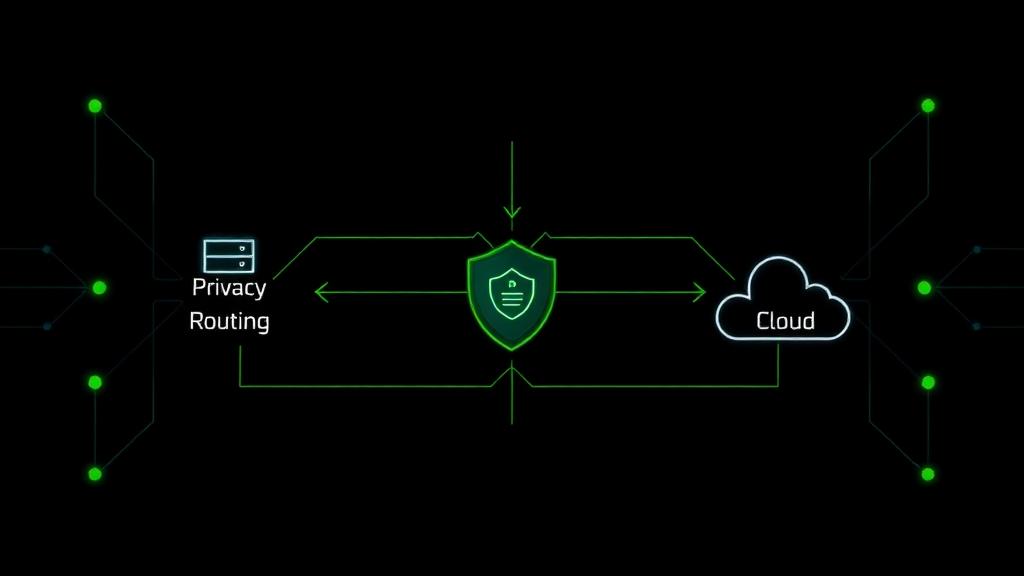

openclaw config set agents.defaults.model.primary "ollama/minimax-m2.5"Hybrid-Strategie: Das Beste aus beiden Welten

Unsere Empfehlung für produktive Teams:

| Aufgabe | Modell | Lokal/Cloud |

|---|---|---|

| E-Mail & Kundendaten | Qwen 3.5 27B | 🏠 Lokal |

| Code Reviews | MiniMax M2.5 | 🏠 Lokal |

| Schnelle Routine-Tasks | Qwen 3.5 35B-A3B | 🏠 Lokal |

| Komplexe Analysen (nicht-sensibel) | Claude 3.5 Sonnet | ☁️ Cloud |

| Bild-Generierung | DALL-E 3 / Flux | ☁️ Cloud |

Regel: Personenbezogene Daten → immer lokal. Alles andere → nach Budget und Qualitätsanspruch.

Fazit

Lokale LLMs sind 2026 kein Kompromiss mehr – sie sind eine strategische Entscheidung. Mit Qwen 3.5 als Effizienz-Champion, MiniMax M2.5 als Coding-Powerhouse und Llama 3.3 als bewährtem Allrounder gibt es für jeden Use Case das passende Modell.

In Kombination mit OpenClaw und Ollama steht ein KI-Agent-Stack, der:

- Nichts kostet (nach Hardware-Amortisation)

- Offline funktioniert

- DSGVO-konform ist (keine Daten an Dritte)

- Cloud-APIs in vielen Szenarien ebenbürtig ist

Der Break-Even liegt bei 3–8 Monaten. Danach ist jeder Token gratis.

Du willst lokale LLMs mit OpenClaw produktiv einsetzen? Sprich mit uns – wir helfen bei Hardware-Empfehlung, Setup und Modell-Auswahl.

Mehr zum Thema: Was ist OpenClaw? · OpenClaw Self-Hosting Guide · NanoClaw: Der schlanke Nachfolger