Tool-Auswahl: Die Nadel im Heuhaufen finden – unser Bewertungsframework

TL;DR: „Tool-Auswahl ist kein Bauchgefühl. Wir bewerten systematisch nach 7 harten Kriterien – von API-Doku bis Roadmap – und validieren die Shortlist dann im echten Netzwerk."

— Till FreitagDas Problem: 14.000 SaaS-Tools und alle klingen gleich

Jede Woche launchen dutzende neue Tools. Jedes verspricht, „das beste" zu sein. Die Landingpages glänzen, die Feature-Listen sind endlos, und irgendwo steht immer „AI-powered" drauf.

Aber wer ein Tool auswählt, das sein Team täglich nutzen soll, braucht mehr als Marketing-Versprechen. Er braucht ein System.

In diesem Artikel zeige ich, wie wir bei Till Freitag Software-Tools bewerten – vom ersten Screening bis zur finalen Empfehlung. Kein Bauchgefühl, sondern ein Framework, das sich in über 400 Projekten bewährt hat.

Phase 1: Die Longlist – 7 Kriterien, die nicht verhandelbar sind

Bevor wir ein Tool überhaupt in die engere Auswahl nehmen, muss es sieben harte Kriterien bestehen. Jedes einzelne ist ein K.O.-Kriterium.

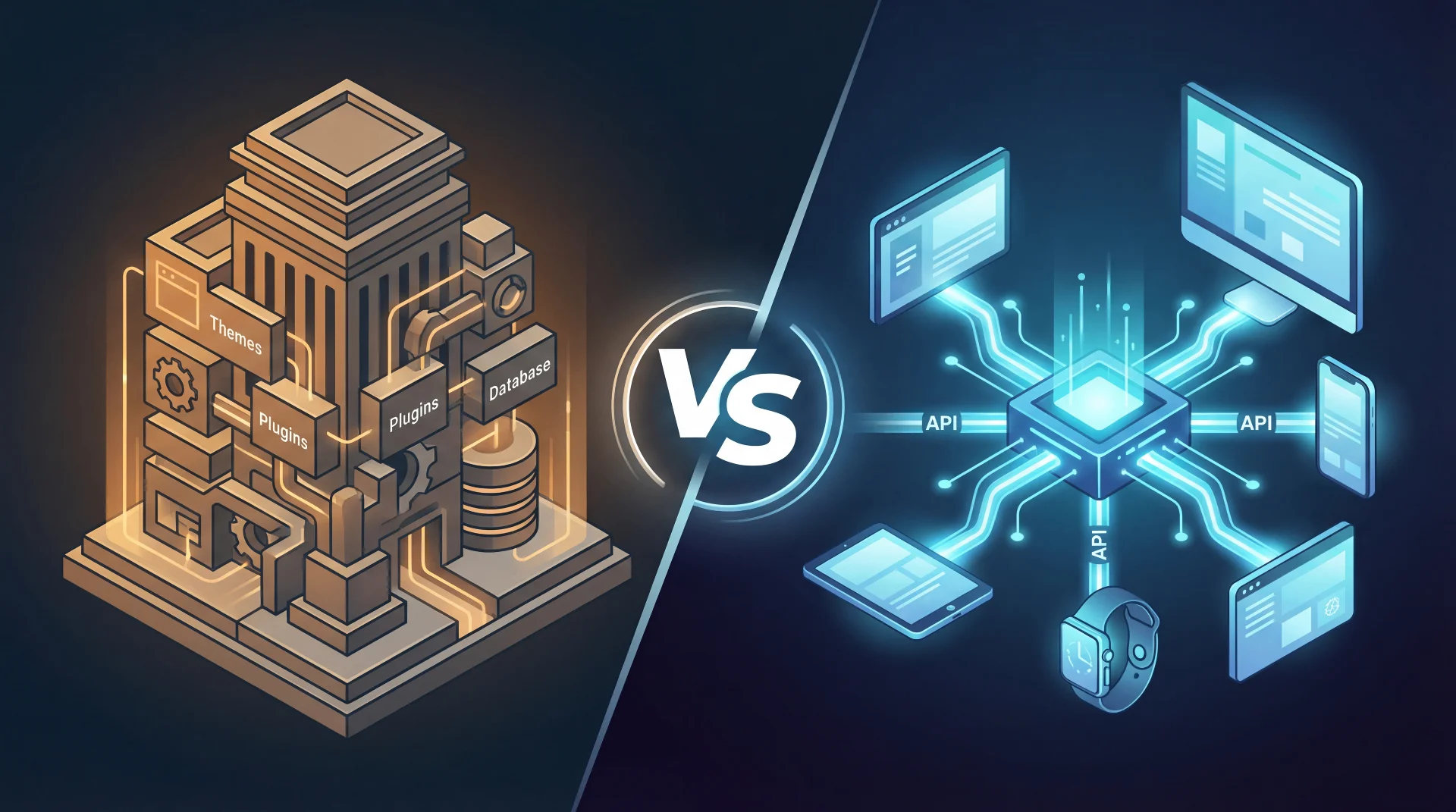

1. API First & API-Dokumentation

Wenn ein Tool keine offene API hat, ist es ein Silo.

Das ist unsere härteste Regel. Ein Tool ohne API kann nicht in bestehende Workflows integriert werden – und wird früher oder später zum Engpass.

Was wir prüfen:

- Gibt es eine REST- oder GraphQL-API?

- Ist die Dokumentation aktuell, vollständig und mit Beispielen versehen?

- Gibt es SDKs oder offizielle Client-Libraries?

- Wie sieht das Rate-Limiting aus?

- Gibt es Webhooks für Event-basierte Integration?

Red Flag: Eine API-Doku, die seit 18 Monaten nicht aktualisiert wurde, ist ein klares Warnsignal.

2. AI-Features & AI-Readiness

KI ist kein Nice-to-have mehr – es ist ein Differenzierungsmerkmal, das zeigt, wie zukunftsfähig ein Produkt ist.

Was wir prüfen:

- Welche KI-Features sind nativ integriert?

- Sind sie tatsächlich nützlich oder nur Marketing?

- Gibt es eine AI-API (z. B. für Custom Agents oder Automationen)?

- Wie transparent ist der Anbieter beim Thema Datenverarbeitung?

- Ist das Tool mit externen LLMs kombinierbar (z. B. via MCP, API)?

Unser Benchmark: monday.com zeigt mit Sidekick, Workflows AI und dem Agent SDK, wie native KI-Integration aussehen kann – ohne dass man ein Data-Science-Team braucht.

3. Bewertungen & User-Feedback

Landingpages lügen. User-Reviews nicht – zumindest nicht alle.

Was wir prüfen:

- G2, Capterra, TrustRadius: Gesamtbewertung und Trend

- Wie reagiert der Anbieter auf negatives Feedback?

- Gibt es wiederkehrende Beschwerden (z. B. Performance, Support)?

- Wie viele Reviews gibt es – und sind sie aktuell?

Pro-Tipp: Filtere Reviews nach Unternehmensgröße und Use Case. Ein Tool, das für 5-Personen-Teams 5 Sterne bekommt, kann für 500-Personen-Organisationen eine Katastrophe sein.

4. Preismodell & Total Cost of Ownership

Der Listenpreis ist nie der echte Preis.

Was wir prüfen:

- Preisstruktur: Per User, per Feature, Flat Rate?

- Versteckte Kosten: Add-ons, API-Calls, Storage, Premium-Support?

- Gibt es einen kostenlosen Tier oder eine echte Testphase?

- Wie sieht die Preishistorie aus? (Regelmäßige Preiserhöhungen?)

- Exit-Kosten: Wie einfach ist der Datenexport?

Was viele vergessen: Die teuersten Tools sind nicht die mit dem höchsten Listenpreis – sondern die, bei denen du nach 2 Jahren merkst, dass du gefangen bist.

5. Unternehmensgröße & Stabilität

Wir empfehlen keine Tools von Unternehmen, die nächstes Jahr nicht mehr existieren könnten.

Was wir prüfen:

- Mitarbeiterzahl und Wachstumstrend

- Finanzierung: Bootstrap, VC-funded, profitabel?

- Kundenanzahl und Referenzkunden

- Standort und Jurisdiktion (DSGVO-Relevanz)

- Gibt es einen EU-Datenspeicher?

Warum das wichtig ist: Ein 12-Personen-Startup mit 3 Mio. Funding kann ein brillantes Produkt bauen – aber wenn der Runway in 8 Monaten endet, hast du ein Problem.

6. Aktuelle Roadmap & Release-Velocity

Ein gutes Produkt heute ist nichts wert, wenn es morgen stagniert.

Was wir prüfen:

- Gibt es eine öffentliche Roadmap?

- Wie oft werden Features released? (Monatlich? Quartalsweise?)

- Werden Community-Requests umgesetzt?

- Gibt es ein Changelog oder Release Notes?

- Wie reagiert das Produkt-Team auf Marktveränderungen?

Best Practice: monday.com veröffentlicht mit monday Elevate und monday Evolve regelmäßig umfassende Product Updates und macht die Roadmap transparent.

7. Anzahl & Qualität der Entwickler

Die Developer-Community ist ein Frühindikator für die Zukunftsfähigkeit eines Tools.

Was wir prüfen:

- Wie viele Entwickler arbeiten am Produkt? (Hinweis auf Investition)

- Gibt es ein Developer-Ökosystem (Marketplace, Apps, Extensions)?

- Wie aktiv ist die Community (GitHub, Forum, Discord)?

- Gibt es offizielle Partner & Integratoren?

- Wie schnell werden Bug-Fixes und Security-Patches ausgerollt?

Phase 2: Von der Longlist zur Shortlist

Nach Phase 1 bleiben typischerweise 3–5 Tools übrig. Jetzt wird es persönlich.

Netzwerk-Validierung

Die beste Due Diligence ist ein Anruf bei jemandem, der das Tool seit 2 Jahren nutzt.

Was wir tun:

- Aktive User im Netzwerk befragen – ehrliches Feedback zu Stärken und Schwächen

- In Fach-Communities (LinkedIn-Gruppen, Slack-Channels, Reddit) nach Erfahrungsberichten suchen

- monday.com Community und Partner-Netzwerk für Insider-Perspektiven nutzen

- Referenzkunden des Anbieters kontaktieren – aber mit eigenen Fragen, nicht mit dem vorbereiteten Sales-Pitch

Hands-on Testing

Kein Tool schafft es auf unsere Empfehlungsliste, ohne dass wir es selbst nutzen.

Unser Test-Protokoll:

- 14-Tage Deep Dive mit realen Use Cases (keine Sandbox-Daten)

- Integration in bestehende Workflows testen (Make, n8n, API)

- Onboarding-Erfahrung dokumentieren: Wie schnell ist ein neuer User produktiv?

- Support-Qualität testen: Ticket schreiben und Response-Zeit messen

- Mobile Experience prüfen – wird die App tatsächlich genutzt oder nur toleriert?

Skalierbarkeits-Check

Was wir simulieren:

- Wie verhält sich das Tool bei 10x Datenvolumen?

- Gibt es Performance-Degradation bei vielen gleichzeitigen Usern?

- Funktioniert die Automatisierung auch bei hohen Volumen zuverlässig?

- Wie gut skaliert der Preis mit der Nutzung?

Vendor-Gespräch

Zum Schluss reden wir mit dem Anbieter direkt – aber nicht über Features.

Unsere Fragen:

- Wie sieht eure Infrastruktur-Strategie für die nächsten 24 Monate aus?

- Wie geht ihr mit Enterprise-Kunden vs. SMB-Kunden um?

- Was ist euer größter technischer Schwachpunkt – und was tut ihr dagegen?

- Wie sieht euer Security-Audit-Prozess aus?

Unser Bewertungs-Scorecard

Am Ende fließt alles in eine gewichtete Scorecard:

| Kriterium | Gewichtung |

|---|---|

| API & Integrierbarkeit | 20% |

| AI-Features & Zukunftsfähigkeit | 15% |

| User-Feedback & Reputation | 10% |

| Preismodell & TCO | 15% |

| Unternehmensstabilität | 10% |

| Roadmap & Innovation | 15% |

| Developer-Ökosystem | 15% |

Die Gewichtung passt sich je nach Kundenkontext an. Für ein Startup mit 10 Mitarbeitern zählt der Preis stärker. Für einen Konzern mit 5.000 Usern ist die API-Tiefe entscheidend.

Fazit: Systematik schlägt Bauchgefühl

Die Nadel im Heuhaufen zu finden ist kein Glücksspiel – es ist Handwerk. Mit einem klaren Framework, ehrlichem User-Feedback und hands-on Testing reduzierst du das Risiko einer Fehlentscheidung dramatisch.

Drei Takeaways:

- Phase 1 ist binär. Ein Tool ohne API oder mit stagnierender Roadmap fliegt raus – egal wie gut die Demo war.

- Phase 2 ist analog. Kein Dashboard ersetzt das Gespräch mit echten Usern.

- Kein Tool ist perfekt. Es geht darum, das Tool zu finden, dessen Schwächen du am besten kompensieren kannst.

Du stehst vor einer Tool-Entscheidung und brauchst eine zweite Meinung? Sprich uns an – wir haben über 400 Projekte begleitet und kennen die Stärken und Schwächen der meisten Plattformen aus erster Hand.

Mehr zum Thema: Unsere Tool-Philosophie · AI-Toolauswahl Strategy · Warum wir auf monday.com setzen