122 Milliarden Parameter auf deinem Laptop – was Qwen3.5 für dein Business bedeutet

TL;DR: „Qwen3.5-122B ist ein Open-Source-Modell mit 122 Milliarden Parametern, das GPT-5-mini schlägt – und auf einem Laptop mit 64 GB RAM läuft. Für Unternehmen mit sensiblen Daten ist das ein Game-Changer."

— Till FreitagDie Nachricht in 30 Sekunden

Alibaba hat Qwen3.5-122B-A10B veröffentlicht. Ein Open-Source-Sprachmodell mit 122 Milliarden Parametern, von denen nur 10 Milliarden gleichzeitig aktiv sind. Das Ergebnis: Ein Modell, das GPT-5-mini in den meisten Benchmarks schlägt – und trotzdem auf einem Laptop mit Unified Memory läuft.

Kein Rechenzentrum. Kein Cloud-Abo. Keine Daten, die dein Gerät verlassen.

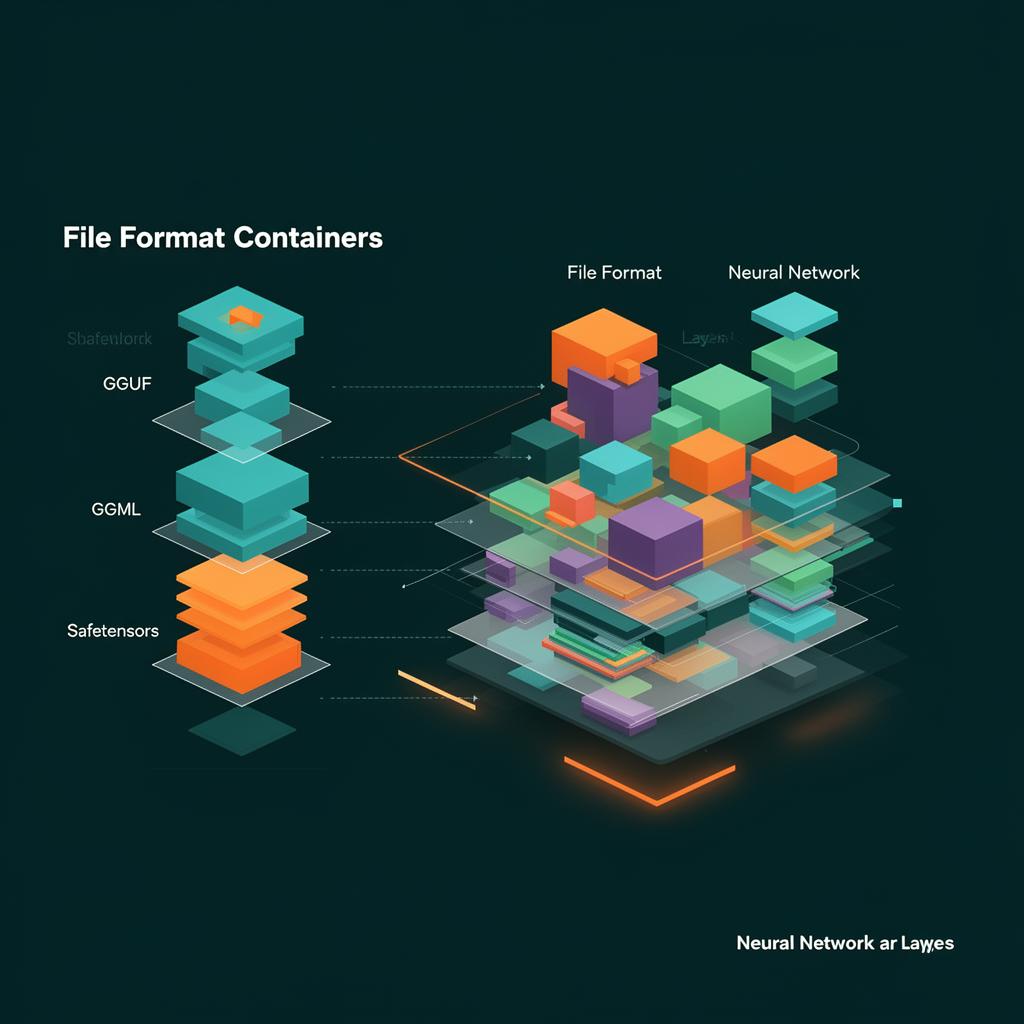

Was ist MoE – und warum ist es wichtig?

MoE steht für Mixture of Experts. Statt alle 122 Milliarden Parameter bei jeder Anfrage zu nutzen, aktiviert das Modell nur die relevanten 10 Milliarden. Stell dir vor, du hast ein Team von 12 Spezialisten – aber pro Aufgabe arbeit nur einer. Das spart Rechenleistung und macht das Modell schnell genug für lokale Hardware.

Die Benchmarks – ehrlich eingeordnet

| Benchmark | Qwen3.5-122B | GPT-5-mini | Was es misst |

|---|---|---|---|

| GPQA Diamond | 86.6 | 82.8 | Wissenschaftliches Reasoning |

| BFCL V4 (Agentic) | 72.2 | 55.5 | Tool-Nutzung & Agenten (+30%) |

| HLE Reasoning | 25.3 | 19.4 | Komplexes logisches Denken |

| SWE-bench Verified | 72.0 | 72.0 | Code-Qualität (gleichauf) |

| Kontextfenster | 262k (→1M) | 128k | Wie viel Text das Modell verarbeitet |

Unsere Einordnung: Die Zahlen sind beeindruckend, besonders bei agentic tasks (+30%). Aber Benchmarks sind nicht alles. In der Praxis zählt, ob das Modell deine Aufgaben gut löst. Trotzdem: Ein Open-Source-Modell, das mit dem zweitstärksten OpenAI-Modell gleichzieht, war vor einem Jahr undenkbar.

Was heißt das für dein Unternehmen?

1. DSGVO ohne Kompromisse

Wenn dein Modell lokal läuft, verlassen keine Daten dein Netzwerk. Keine API-Calls an US-Server. Kein Auftragsverarbeitungsvertrag mit OpenAI. Kein Risiko. Für Unternehmen in regulierten Branchen – Healthcare, Finance, öffentlicher Sektor – ist das ein echter Durchbruch.

2. Kosten: Einmal investieren statt monatlich zahlen

Ein Laptop mit 64 GB Unified Memory (z.B. MacBook Pro M4 Max) kostet einmalig. Danach: null laufende Kosten für AI-Inferenz. Vergleich: GPT-5-mini kostet $2/1M Input-Tokens. Bei hohem Volumen rechnet sich lokal schnell.

3. AI-Agenten ohne Cloud-Abhängigkeit

Mit 72.2 auf dem BFCL-Benchmark ist Qwen3.5 eines der besten Modelle für Tool-Nutzung. Das bedeutet: lokale AI-Agenten, die dein CRM abfragen, E-Mails zusammenfassen oder Workflows triggern – alles on-premise.

Wo es (noch) nicht reicht

Ehrlich bleiben:

- Multimodal: Kein Bild-/Video-/Audio-Verständnis wie bei GPT-5 oder Gemini

- Ecosystem: Kein Plugin-Store, keine GUI out-of-the-box – du brauchst technisches Setup

- Support: Community statt Enterprise-SLA

- Speed: Lokal langsamer als Cloud-APIs mit dedizierten GPUs

Unser Take: Nicht entweder-oder

Wir empfehlen keinem Kunden, komplett auf lokale Modelle zu wechseln. Aber wir sehen klare Use Cases:

| Szenario | Empfehlung |

|---|---|

| Sensible Dokumente analysieren | ✅ Lokal mit Qwen3.5 |

| Kunden-Chatbot mit Tool-Anbindung | ☁️ Claude oder GPT-5 via API |

| Bulk-Klassifizierung interner Daten | ✅ Lokal oder Gemini Flash |

| Kreatives Brainstorming | ☁️ Claude Opus oder GPT-5 |

| Prototyping & Testing | ✅ Lokal – kostet nichts pro Anfrage |

Der smarte Ansatz: Cloud für Qualität, lokal für Datenschutz und Volumen. Nicht entweder-oder, sondern beides.

Was jetzt zu tun ist

- Prüfe deine Use Cases. Wo verarbeitest du sensible Daten mit AI? Das sind die Kandidaten für lokal.

- Teste mit deinen echten Daten. Benchmarks sind nett, aber nur dein eigener Test zählt.

- Plane die Hardware. 64 GB RAM ist das Minimum für Qwen3.5 in brauchbarer Qualität.

- Bleib flexibel. In 6 Monaten gibt es vielleicht ein noch besseres Open-Source-Modell. Bau keine Abhängigkeit auf.

Fazit

Was vor sechs Monaten ein Rechenzentrum brauchte, läuft heute auf einem Laptop-Chip. Das ist keine Spielerei – das ist eine strategische Option für jedes Unternehmen, das AI nutzen will, ohne die Kontrolle über seine Daten abzugeben.

Die Zukunft gehört nicht einem Modell. Sie gehört der Architektur, die flexibel genug ist, das jeweils beste Modell zu nutzen – egal ob Cloud oder lokal.

→ Mehr über unsere AI-Services → Warum wir von ChatGPT zu Claude gewechselt sind