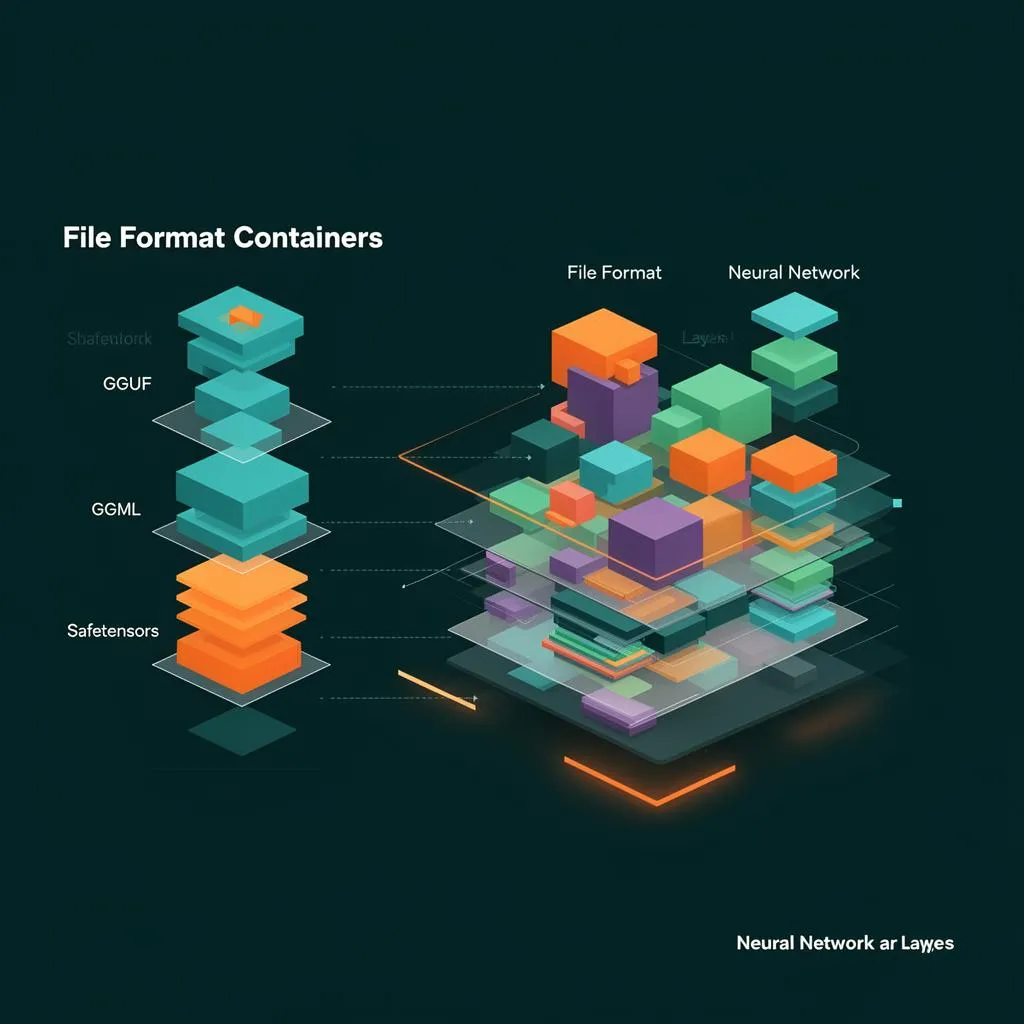

GGUF, GGML, Safetensors – welches Format für dein lokales AI-Setup?

TL;DR: „GGUF ist der aktuelle Standard für lokale AI. GGML ist veraltet. Safetensors ist das sichere Austauschformat der Hugging-Face-Welt. Wer lokal AI nutzen will, muss die Unterschiede kennen."

— Till FreitagWarum dich Dateiformate interessieren sollten

Du willst ein Open-Source-Modell lokal ausprobieren. Du gehst auf Hugging Face, suchst nach Qwen3.5 oder Llama 4 – und siehst vier verschiedene Downloads: .gguf, .ggml, .safetensors, .bin. Welches brauchst du?

Die Antwort ist nicht kompliziert, aber sie ist wichtig. Denn das falsche Format heißt: dein Modell startet nicht, läuft langsam, oder – im schlimmsten Fall – führt unsicheren Code aus.

Die drei Formate im Überblick

| Format | Status | Haupteinsatz | Sicherheit |

|---|---|---|---|

| GGML | ❌ Veraltet | Frühes llama.cpp | Keine Validierung |

| GGUF | ✅ Aktuell | Lokale Inferenz (CPU/GPU) | Metadaten + Validierung |

| Safetensors | ✅ Aktuell | Training & Austausch (GPU) | Kein Code-Execution-Risiko |

GGML – der Pionier, der in Rente ist

GGML war das erste Format, das es ermöglichte, große Sprachmodelle auf normaler Hardware laufen zu lassen. Entwickelt von Georgi Gerganov (daher das "GG") als Teil von llama.cpp.

Das Problem: GGML hatte kein standardisiertes Metadaten-Schema. Jedes Modell brauchte eigene Konfigurationsdateien. Updates am Format waren breaking changes. Seit August 2023 ist GGML offiziell durch GGUF ersetzt.

Unser Take: Wenn du irgendwo noch .ggml-Dateien findest, sind sie museumsreif. Nicht verwenden.

GGUF – der Standard für lokale AI

GGUF (GPT-Generated Unified Format) ist der Nachfolger von GGML und löst alle dessen Probleme:

- Alles in einer Datei: Modellgewichte, Tokenizer, Konfiguration – alles gebündelt

- Versioniert: Format-Updates ohne Breaking Changes möglich

- Quantisierung eingebaut: Q4_K_M, Q5_K_S, Q8_0 – du wählst den Trade-off zwischen Qualität und RAM-Verbrauch

- Breite Tool-Unterstützung: llama.cpp, Ollama, LM Studio, GPT4All, Jan – alles spricht GGUF

Quantisierung – was die Kürzel bedeuten

Wenn du auf Hugging Face ein GGUF-Modell siehst, stehen oft mehrere Varianten zur Wahl:

| Variante | RAM-Bedarf (7B-Modell) | Qualität | Wann nutzen? |

|---|---|---|---|

| Q4_K_M | ~4.5 GB | Gut | Standard für Laptops |

| Q5_K_M | ~5.5 GB | Sehr gut | Wenn RAM reicht |

| Q6_K | ~6.5 GB | Exzellent | Qualitätsfokus |

| Q8_0 | ~8 GB | Nahezu verlustfrei | Wenn du 64 GB RAM hast |

| F16 | ~14 GB | Original | Nur für Vergleichstests |

Faustregel: Q4_K_M ist der Sweet Spot für die meisten Use Cases. Weniger als Q4 merkst du in der Ausgabequalität.

Safetensors – das sichere Austauschformat

Safetensors wurde von Hugging Face entwickelt und löst ein konkretes Sicherheitsproblem: Das alte PyTorch-Format (.bin / .pt) nutzt Python's pickle zum Serialisieren. Pickle kann beliebigen Code ausführen. Das heißt: Ein manipuliertes Modell könnte beim Laden Schadcode auf deinem Rechner starten.

Safetensors macht das unmöglich:

- Kein Code-Execution: Reine Daten, kein ausführbarer Code

- Schnelles Laden: Memory-Mapped I/O – das Modell wird nicht komplett in den RAM kopiert

- Framework-agnostisch: Funktioniert mit PyTorch, TensorFlow, JAX, Flax

Wann Safetensors, wann GGUF?

| Szenario | Format |

|---|---|

| Modell lokal auf CPU/Laptop laufen lassen | GGUF |

| Modell fine-tunen oder weitertrainieren | Safetensors |

| Modell auf Hugging Face teilen | Safetensors |

| Modell in Ollama oder LM Studio laden | GGUF |

| Modell auf GPU-Server deployen (vLLM, TGI) | Safetensors |

Kurzfassung: Safetensors ist das Format für die GPU-Welt (Training, Server). GGUF ist das Format für die CPU-Welt (Laptop, lokale Inferenz).

Die Rolle von Open Source

Hier wird es strategisch interessant. Alle drei Formate sind Open Source. Das bedeutet:

- Kein Vendor Lock-in: Du bist nicht an einen Anbieter gebunden. Ein GGUF-Modell läuft in jedem Tool, das GGUF unterstützt.

- Community-getrieben: Die Quantisierung wird oft von der Community gemacht (z.B. TheBloke, bartowski auf Hugging Face). Du profitierst von tausenden Freiwilligen.

- Transparenz: Du kannst prüfen, was in der Datei steckt. Bei proprietären APIs musst du dem Anbieter vertrauen.

- Kombinierbar: Safetensors-Modell herunterladen → mit llama.cpp zu GGUF konvertieren → lokal nutzen. Der Workflow ist komplett offen.

Warum das für Unternehmen relevant ist

Open-Source-Formate entkoppeln das Modell vom Tool. Das heißt:

- Du kannst heute Ollama nutzen und morgen zu LM Studio wechseln

- Du kannst Modelle von verschiedenen Anbietern (Meta, Alibaba, Mistral) im selben Setup betreiben

- Du bist nicht an ein Ökosystem gebunden – anders als bei OpenAI, Anthropic oder Google

Der praktische Workflow: Von Hugging Face auf deinen Laptop

- Modell wählen: Gehe auf huggingface.co und suche dein Modell

- Format prüfen: Für lokale Nutzung → GGUF-Tab suchen. Oft gibt es Community-Quantisierungen

- Quantisierung wählen: Q4_K_M für Standard, Q5_K_M wenn RAM da ist

- Tool installieren: Ollama (

ollama pull model), LM Studio (Drag & Drop), oder llama.cpp (CLI) - Loslegen: Das Modell läuft. Keine API-Keys, keine Cloud, keine laufenden Kosten

Was jetzt zu tun ist

- Verstehe den Unterschied: GGUF = lokal nutzen, Safetensors = trainieren/teilen, GGML = vergessen

- Teste mit GGUF: Lade ein Q4_K_M-Modell in Ollama oder LM Studio – dauert 5 Minuten

- Plane dein Setup: Für sensible Daten ist lokal+GGUF der DSGVO-konforme Weg

- Bleib formatflexibel: Open Source heißt, du kannst jederzeit konvertieren und wechseln

Fazit

Dateiformate sind nicht sexy. Aber sie entscheiden darüber, ob dein lokales AI-Setup funktioniert oder nicht. GGUF hat sich als Standard durchgesetzt, Safetensors als sicheres Austauschformat. GGML ist Geschichte.

Das Beste daran: Alles ist Open Source. Du bist nicht abhängig von einem Anbieter, einem Tool oder einem Format. Du wählst das, was zu deinem Use Case passt – und kannst jederzeit wechseln.

→ Wie Qwen3.5 auf deinem Laptop läuft → Mehr über unsere AI-Services