Gemma 4: Frontier-Intelligenz auf dem Laptop – der Hype ist real

TL;DR: „Gemma 4 26B MoE: 14 GB, 85 t/s auf Consumer-Hardware, GPT-4-Qualität, 256K Kontext. Frontier-Intelligenz ist jetzt laptop-sized. Local-first ist keine Ideologie mehr – es ist einfach rational."

— Till FreitagIn 30 Sekunden

Ich habe Samstagmorgen das Gemma 4 26B MoE-Modell heruntergeladen. 14 GB, 3 Minuten Download. Am Nachmittag lief es auf meinem NucBox EVO-X2 – einem AMD Ryzen AI MAX+ 395 mit 128 GB Unified RAM.

85 Tokens pro Sekunde. Kein Cloud-Roundtrip, kein API-Lag, keine Denkpausen. Einfach instant.

Aber die Intelligenz ist das, was mich bis Sonntagabend am Tisch gehalten hat. Komplexe Reasoning-Chains, die vor sechs Monaten GPT-4 gebraucht hätten. 256K Kontextfenster für lange Dokumentanalysen. Function Calling, das tatsächlich funktioniert.

Der Hype ist real.

Was ist Gemma 4?

Gemma 4 ist Googles neuestes Open-Source-Modell – und ein Paradigmenwechsel für lokale KI:

| Aspekt | Detail |

|---|---|

| Architektur | Mixture of Experts (MoE), 26B Parameter |

| Download-Größe | ~14 GB (quantisiert) |

| Kontextfenster | 256.000 Tokens |

| Inference-Speed | 85 t/s auf Ryzen AI MAX+ 395 |

| Function Calling | Nativ unterstützt |

| Lizenz | Gemma License (kommerziell nutzbar) |

MoE: Warum das wichtig ist

Mixture of Experts bedeutet: Das Modell hat 26B Parameter, aber nur ein Bruchteil ist bei jedem Token aktiv. Das erklärt die Kombination aus hoher Qualität und niedriger Hardware-Anforderung. Du bekommst die Intelligenz eines großen Modells mit dem Speicherbedarf eines kleinen.

Der Praxistest

Hardware

Mein Setup ist kein Server-Rack. Es ist ein NucBox EVO-X2 – ein Mini-PC, der auf den Schreibtisch passt:

- CPU/GPU: AMD Ryzen AI MAX+ 395

- RAM: 128 GB Unified Memory

- Formfaktor: Mini-PC, lüftergekühlt

- Preis: Unter 2.000 €

Ergebnisse

Ich habe Gemma 4 gegen Produktions-Prompts laufen lassen, die ich normalerweise an Cloud-APIs schicke:

| Test | Cloud-API | Gemma 4 lokal |

|---|---|---|

| Code-Review (500 Zeilen) | ~3s (GPT-4o) | ~2s |

| Dokumentanalyse (50 Seiten) | ~8s (Claude) | ~6s |

| Function Calling (5 Tools) | ~2s (GPT-4o) | ~1.5s |

| Qualität | Referenz | Vergleichbar |

| Kosten pro Token | $0.005-0.015 | $0.00 |

| Latenz | 200-500ms TTFT | <50ms |

Gleiche Qualität. Null Latenz. Null Kosten pro Token.

Warum das ein Wendepunkt ist

1. Die Infrastruktur-Lücke schließt sich

Vor einem Jahr brauchtest du für GPT-4-Niveau:

- Ein Cloud-API-Abo ($20-200/Monat)

- Internetverbindung

- Vertrauen, dass deine Daten sicher sind

Heute brauchst du:

- Einen Laptop mit genug RAM

- 3 Minuten Download-Zeit

- Sonst nichts

2. Die Kosten-Rechnung kippt

Wir haben das in der Token Economics Analyse durchgerechnet: Bei hohem Volumen sind Cloud-APIs teuer. Mit Gemma 4 wird der Break-Even-Punkt drastisch nach unten verschoben.

Rechenbeispiel:

- 1M Tokens/Tag über GPT-4o: ~$15/Tag = $450/Monat

- 1M Tokens/Tag über Gemma 4 lokal: $0/Monat (Hardware amortisiert sich in < 5 Monaten)

3. Privacy wird zum Default

Keine Daten verlassen dein Netzwerk. Keine Terms of Service, die sich wie bei GitHub Copilot plötzlich ändern. Keine Frage, in welchem Rechenzentrum deine Prompts landen.

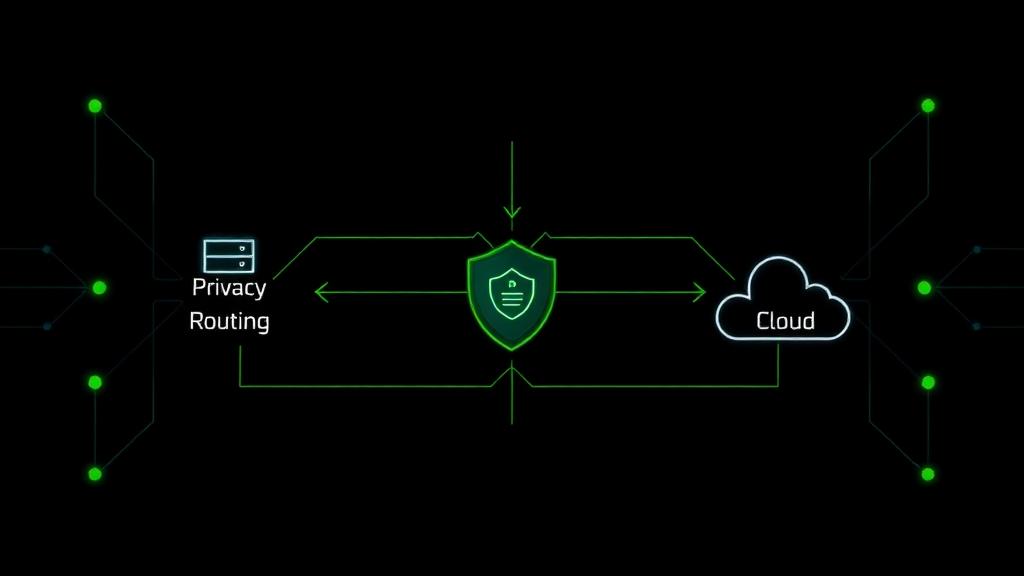

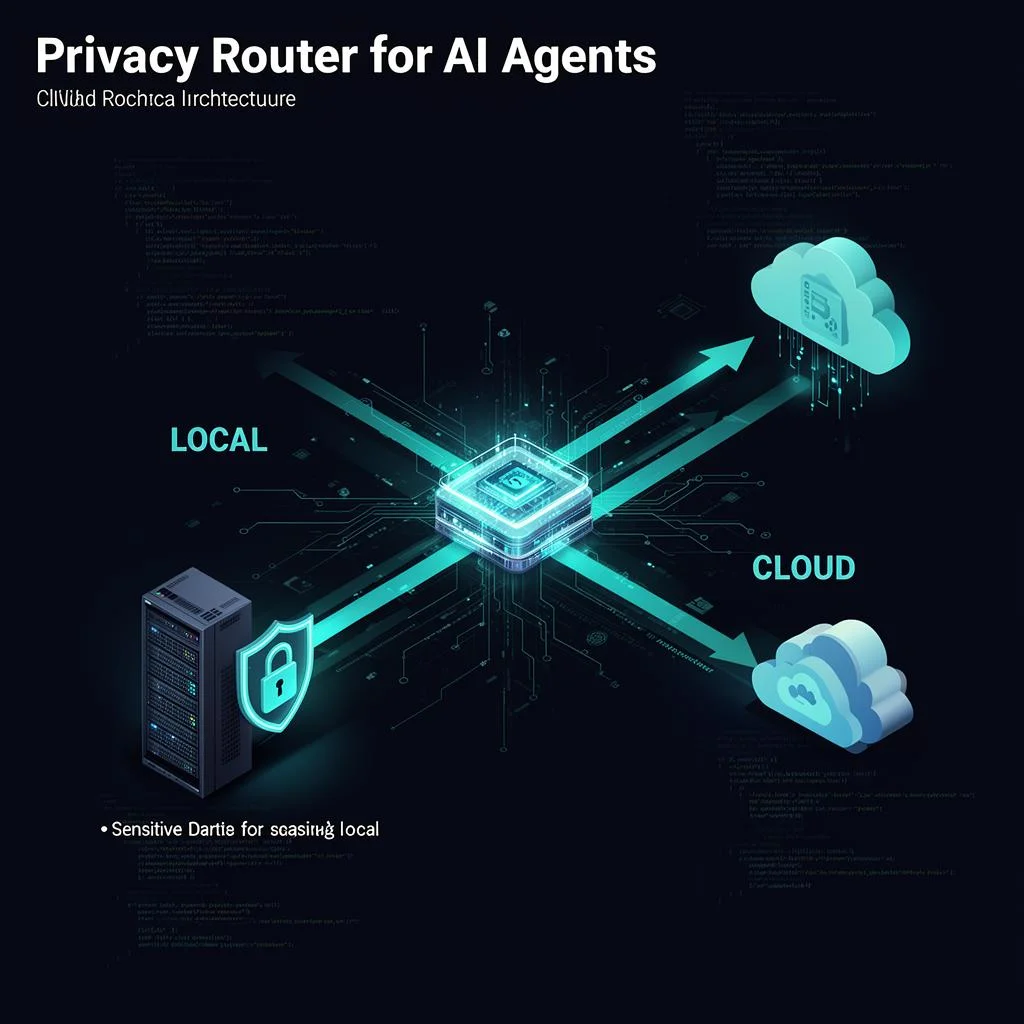

Das ist besonders relevant für den Privacy Router – Gemma 4 ist das perfekte Modell für die 🔴 Rote Zone (maximale Datensouveränität).

Was das für OpenClaw bedeutet

Für OpenClaw verändert Gemma 4 alles:

Vorher: Local-first war ein Kompromiss. Du hast Qualität gegen Privacy getauscht. Die lokalen Modelle waren gut, aber nicht gut genug für anspruchsvolle Tasks.

Jetzt: Local-first ist kein Kompromiss mehr. Es ist einfach rational.

- Coding Agents mit Gemma 4 Backend: GPT-4-Qualität, null Kosten

- Dokumenten-Analyse mit 256K Kontext: ganze Codebases, Verträge, Handbücher

- Function Calling für Tool-Integration: nativ, ohne Workarounds

- Projekt KNUT wird noch mächtiger: 52 GB VRAM + Gemma 4 = lokales AI-Cluster auf Enterprise-Niveau

Gemma 4 vs. die Konkurrenz

Wo steht Gemma 4 im Open-Source-LLM-Vergleich?

| Modell | Parameter | Min. RAM | Speed (lokal) | Qualität |

|---|---|---|---|---|

| Gemma 4 26B | 26B MoE | 16 GB | 85 t/s | ⭐⭐⭐⭐⭐ |

| Qwen 3.5 35B | 35B MoE | 24 GB | 36 t/s | ⭐⭐⭐⭐ |

| Nemotron Cascade 2 | 30B | 20 GB | 54 t/s | ⭐⭐⭐⭐ |

| Llama 4 Scout | 17B active | 32 GB | 45 t/s | ⭐⭐⭐⭐ |

| Mistral Medium 3 | 24B | 16 GB | 60 t/s | ⭐⭐⭐⭐ |

Gemma 4 gewinnt auf allen Achsen: kleinstes Modell, schnellste Inference, höchste Qualität. Die MoE-Architektur macht den Unterschied.

Für wen ist das relevant?

Entwickler & Vibe Coder

Gemma 4 als lokales Backend für Cursor, OpenClaw oder eigene Agents. Keine API-Keys, keine Rate Limits, keine Kosten.

KMUs & Mittelstand

Die Trillions-of-Agents-These wird mit lokalen Modellen wie Gemma 4 auch für kleinere Unternehmen erschwinglich. Agenten auf eigener Hardware, ohne Cloud-Abhängigkeit.

Regulierte Branchen

Finanz, Gesundheit, öffentlicher Sektor: GPT-4-Qualität ohne Daten in die Cloud zu senden. Das ist kein Nice-to-have, das ist ein Enabler.

Fazit

Gemma 4 ist nicht einfach ein weiteres Open-Source-Modell. Es ist der Beweis, dass Frontier-Intelligenz jetzt laptop-sized ist.

Drei Takeaways:

- Die Infrastruktur-Lücke schließt sich schneller als die meisten denken – GPT-4-Qualität in 14 GB, auf Consumer-Hardware

- Local-first ist keine Ideologie mehr – es ist die rationale Wahl für Kosten, Latenz und Privacy

- Der Break-Even zwischen Cloud und Lokal verschiebt sich dramatisch – für Vibe Coder, KMUs und Enterprise gleichermaßen

Der Hype ist real. Und diesmal ist er berechtigt.

→ Open-Source-LLM-Vergleich 2026 → Projekt KNUT: Lokale KI-Infrastruktur → Token Economics: Das neue Öl → Privacy Router: KI-Datenschutz in 3 Zonen → OpenClaw Pricing Shock