Model Routing Guide – Welches AI-Modell für welchen Task?

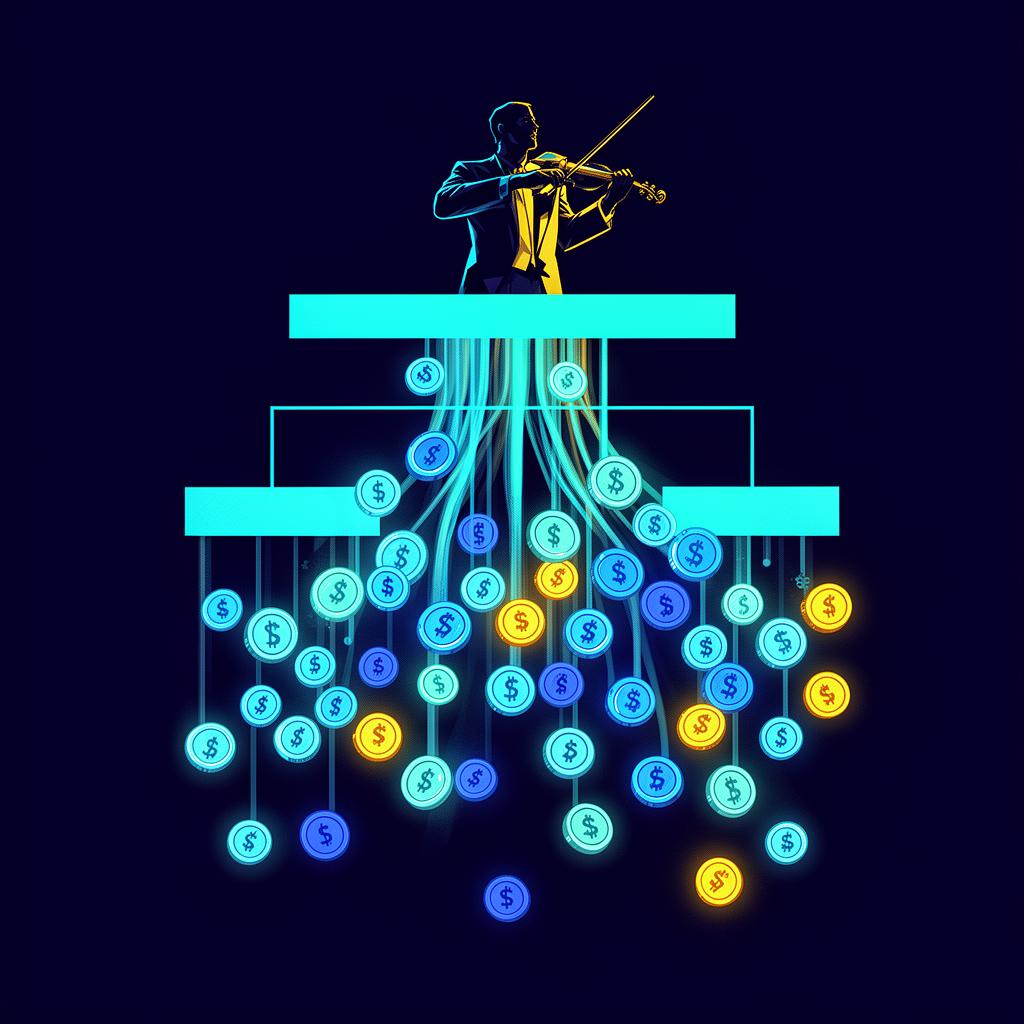

Das Problem: Ein Modell für alles

Die meisten Teams machen den gleichen Fehler: Sie nehmen GPT-4o oder Claude Sonnet für alles. Jede E-Mail, jede Zusammenfassung, jede Datenextraktion, jede Code-Review.

Das ist wie mit dem Porsche zum Bäcker fahren. Funktioniert, aber du verbrennst Geld.

Die Realität: 70% aller AI-Tasks brauchen kein Frontier-Modell. Sie brauchen ein schnelles, günstiges Modell, das den Job erledigt. Die restlichen 30% brauchen vielleicht sogar mehr als ein Frontier-Modell – sie brauchen ein Reasoning-Modell.

Model Routing löst genau das: Das richtige Modell für den richtigen Task. Automatisch.

Die Routing-Matrix: 4 Stufen

Wir teilen Tasks in vier Stufen ein – jede mit einem optimalen Modell-Typ:

Stufe 1: Commodity Tasks (Budget-Modelle)

Kosten: $0.40–0.60 / 1M Output-Tokens

| Task | Warum Budget reicht |

|---|---|

| Text-Klassifikation | Sentiment, Kategorisierung – trivial für jedes LLM |

| Datenextraktion | Strukturierte Felder aus Dokumenten ziehen |

| Einfache Zusammenfassungen | Meeting-Notes, E-Mail-Digests |

| Übersetzungen | Standard-Content ohne Nuancen |

| Template-Generierung | Standardisierte E-Mails, Antworten |

Empfohlene Modelle:

- Gemini 2.0 Flash – $0.40/1M Output, unschlagbar günstig

- GPT-4o mini – $0.60/1M Output, solide Allround-Performance

- DeepSeek V3 – $1.10/1M Output, starkes Preis-Leistungs-Verhältnis

- Llama 4 Maverick (via Groq) – $0.60/1M Output, open-source

Stufe 2: Professional Tasks (Mid-Tier-Modelle)

Kosten: $4.00–6.00 / 1M Output-Tokens

| Task | Warum Mid-Tier |

|---|---|

| Content-Erstellung | Blog-Artikel, Marketing-Texte mit Markentonalität |

| Code-Generierung | Standard-Features, Boilerplate, Refactoring |

| Kunden-Support | Nuancierte, empathische Antworten |

| Datenanalyse | Zusammenhänge erkennen, Muster beschreiben |

Empfohlene Modelle:

- Claude 3.5 Haiku – $4.00/1M Output, Anthropic-Qualität zum Mid-Tier-Preis

- Mistral Large – $6.00/1M Output, starkes europäisches Modell

Stufe 3: Frontier Tasks (Premium-Modelle)

Kosten: $10.00–25.00 / 1M Output-Tokens

| Task | Warum Frontier |

|---|---|

| Strategische Analysen | Komplexe Geschäftsentscheidungen mit Kontext |

| Agentic Coding | Multi-File-Refactoring, Architektur-Entscheidungen |

| Kreatives Schreiben | Thought Leadership, differenzierter Content |

| Komplexe Recherche | Multi-Source-Synthese mit kritischer Bewertung |

Empfohlene Modelle:

- Claude Opus 4.7 – $25.00/1M Output, neuer Premium-Default in Cowork & Claude Code (seit April 2026), bestes Modell für agentic Coding und professionelle Outputs

- GPT-4o – $10.00/1M Output, der Allrounder

- Claude Sonnet 4.6 – $15.00/1M Output, beste Balance aus Qualität und Preis für Standard-Frontier-Tasks

- Gemini 2.5 Pro – $10.00/1M Output, riesiges Kontextfenster

Wichtig seit April 2026: Premium-Seats bei Anthropic bekommen automatisch Opus 4.7 als Default in Cowork, Claude Code und Chat. Standard-Seats bleiben auf Sonnet 4.6. Mehr dazu: Claude Opus 4.7 Release-Analyse.

Stufe 3b: Effort-Level richtig wählen (Claude Code)

Mit Opus 4.7 hat Anthropic ein neues Effort-Level eingeführt: xhigh (zwischen high und max). Es ist seit April 2026 der Default für Premium-Seats – und kann eine Coding-Session 20–30 % teurer machen als Opus 4.6 bei max.

Unsere Routing-Empfehlung innerhalb von Claude Code:

| Effort-Level | Wann nutzen | Typische Aufgabe |

|---|---|---|

medium |

Schnelle, klar umrissene Edits | Bugfix in einer Datei, Komponenten-Rename, kleine Refactorings |

high |

Standard-Feature-Entwicklung | Neue Komponente mit 3–5 Files, Standard-API-Integration |

xhigh (Default) |

Komplexe Multi-File-Refactorings | Architektur-Migrationen, schwierige Bugs mit unklarer Ursache |

max |

Wirklich harte Probleme | Algorithmische Optimierungen, kritische Security-Reviews |

Faustregeln:

- Setze den Team-Default per Server-Managed Settings auf

high– nichtxhigh. Werxhighbraucht, schaltet es bewusst pro Session hoch. xhighlohnt sich, wenn der Mensch sonst 30+ Minuten manuell debuggen würde. Bei einfachen Tasks zahlst du für „Nachdenken", das du nicht brauchst.maxnur für Aufgaben, bei denen Fehler richtig teuer wären. In 90 % der Coding-Sessions isthighausreichend.

Stufe 4: Reasoning Tasks (Spezial-Modelle)

Kosten: $2.19–40.00 / 1M Output-Tokens

| Task | Warum Reasoning |

|---|---|

| Mathematische Beweise | Schrittweises logisches Denken |

| Architektur-Design | Abwägung komplexer Trade-offs |

| Debugging schwieriger Bugs | Hypothesenbildung und systematische Analyse |

| Compliance-Prüfung | Regelwerke gegen Dokumente prüfen |

Empfohlene Modelle:

- DeepSeek R1 – $2.19/1M Output, Open-Source Reasoning zum Budget-Preis

- OpenAI o3 – $40.00/1M Output, stärkstes Reasoning, aber teuer

Das Routing in der Praxis: Ein Beispiel

Stell dir vor, ein Support-Team verarbeitet 1.000 Tickets pro Monat mit AI:

| Ohne Routing | Mit Routing |

|---|---|

| Alles über Claude Sonnet | Stufe 1 für 700 Standard-Tickets |

| 1M Output-Tokens × $15 = $15.00 | Stufe 2 für 250 komplexe Tickets |

| Stufe 3 für 50 Eskalationen | |

| $3.85 (74% günstiger) |

Die Qualität der Antworten? Identisch. Ein „Wo ist mein Paket?"-Ticket braucht kein Frontier-Modell.

Der Privacy-Layer: Datensensitivität als Routing-Kriterium

Model Routing ist nicht nur eine Kostenfrage – es ist auch eine Datenschutzfrage.

Unsere Empfehlung: Ein dreistufiges Privacy-Routing:

- 🟢 Öffentliche Daten → Cloud-Modelle (GPT-4o, Claude, Gemini)

- 🟡 Interne Daten → EU-gehostete Modelle (Mistral, EU-Bedrock)

- 🔴 Sensible Daten → Lokale Modelle (Llama lokal, Nemotron Nano)

Das Prinzip: Die Daten bestimmen das Modell, nicht umgekehrt.

Sensible HR-Daten, Gehaltsinformationen oder Kundendaten sollten niemals an US-Cloud-APIs gehen – egal wie gut das Modell ist. Ein lokales Llama-Modell reicht für die Klassifikation von Personalakten völlig aus.

🔐 Deep Dive: Unser Privacy Router Guide zeigt Schritt für Schritt, wie du das Drei-Zonen-Modell implementierst – inklusive EU AI Act Compliance und Kill-Switch-Hierarchie.

Wie du Model Routing implementierst

Option 1: Manuelles Routing (Sofort umsetzbar)

Erstelle eine einfache Entscheidungstabelle für dein Team:

IF task = Klassifikation/Extraktion → Gemini Flash

IF task = Content/Code → Claude Haiku

IF task = Strategie/Kreativ → Claude Sonnet

IF task = Reasoning/Debugging → DeepSeek R1

IF data = sensibel → Lokales ModellOption 2: Automatisches Routing (mit make.com oder n8n)

Baue einen Workflow, der eingehende Requests analysiert und automatisch ans richtige Modell weiterleitet:

- Classifier (Gemini Flash, kostet fast nichts): Bewertet Komplexität + Datensensitivität

- Router: Leitet an das passende Modell weiter

- Fallback: Wenn das Budget-Modell scheitert, Upgrade auf nächste Stufe

Option 3: OpenRouter als Meta-Layer

OpenRouter aggregiert 200+ Modelle unter einer API. Du kannst:

- Modelle per Request wechseln

- Fallback-Ketten definieren

- Kosten pro Modell tracken

Die Kostenrechnung

Rechne es für dein eigenes Setup durch: Unser AI Token Rechner zeigt dir, was du bei jedem Anbieter für dein Budget bekommst.

Ein typisches Unternehmen, das Model Routing einführt, spart 60–80% der AI-Kosten – bei gleicher oder besserer Output-Qualität. Warum besser? Weil Reasoning-Modelle bei Reasoning-Tasks tatsächlich besser sind als Frontier-Modelle.

Die Quintessenz

Model Routing ist kein Nice-to-have. Es ist die erste Optimierung, die jedes Unternehmen machen sollte, bevor es über AI-Strategie redet.

Die Logik ist simpel:

- 70% deiner Tasks brauchen das günstigste Modell

- 25% deiner Tasks brauchen ein gutes Modell

- 5% deiner Tasks brauchen das beste Modell

- 0% deiner Tasks brauchen für alles das gleiche Modell

Wer das versteht, spart nicht nur Geld – sondern baut bessere AI-Systeme.

🧮 Was kostet dein AI-Setup wirklich? Rechne es durch mit unserem AI Token Rechner – kostenlos, ohne Anmeldung.

🎬 YouTube-Quellen effizient verarbeiten? NotebookLM + Claude Code zeigt, wie du Hunderte Video-Quellen indexierst – ohne Token zu verbrennen.

Du willst Model Routing für dein Team einführen? Sprich mit uns – wir bauen die Routing-Logik mit dir auf. In Tagen, nicht Monaten.