Token Maxxing: Wenn AI vom Suchwerkzeug zur Infrastruktur wird

TL;DR: „Top-AI-Spender haben ihren Umsatz seit 2023 verdoppelt, das untere Quartil stagniert. Der Unterschied: Sie pumpen alles durch das Context-Window – Verträge, Calls, Proposals – und verschieben den Menschen vom Ausführen zum Orchestrieren von Agents."

— Till FreitagDie meisten Teams nutzen AI falsch

Sie öffnen ChatGPT, stellen eine Frage, kopieren die Antwort, schließen den Tab. Wiederholung am nächsten Tag. AI als bessere Suchmaschine.

Die Teams, die gerade brutal davonziehen, machen etwas anderes. Sie behandeln AI nicht als Werkzeug, sondern als Infrastruktur – wie Strom, wie das Internet, wie ihre Datenbank. Alles, was im Unternehmen passiert, läuft durch das Context-Window: Meeting-Notes, Verträge, Proposals, Kundengespräche, Tickets, Job-Dokumentation.

Dafür gibt es einen Begriff: Token Maxxing. Und die Daten dazu sind nicht subtil.

Die Ramp-Daten: Das Delta wird brutal

Ramp wertet AI-Spend von über 50.000 Unternehmen aus. Seit 2023 hat das obere Quartil seinen Umsatz verdoppelt. Das untere Quartil: flach.

Zwei konkrete Beispiele aus dem US-Mittelstand:

- Eine Bauunternehmung in Florida mit ~$20 Mio Umsatz, die LLMs systematisch auf Verträge und Papierkram loslässt: +65 %.

- Ein Fenster-Installateur aus Utah, der seit über einem Jahr jeden Monat AI-Tools für Proposals nutzt: +59 %.

Das sind keine YC-Startups mit GPU-Clustern. Das sind klassische Mittelständler, die einen einfachen Move gemacht haben: Stop, AI für One-Offs zu nutzen. Start, den ganzen Workflow durch sie zu routen.

Das Pattern in High-AI-Organisationen

Wenn du dir Unternehmen anschaust, die diese Transition geschafft haben, siehst du immer dasselbe Muster:

| Anti-Pattern | Token Maxxing |

|---|---|

| AI nur für Engineers | Jede Rolle hat AI-Zugang – Sales, Ops, HR, Finance |

| Einzel-Prompts, manuelles Copy-Paste | Token-Max alles, was durch die Org fließt |

| One-Off-Skripte | Agentify jeden Prozess mit wiederholbarem Pattern |

| Mensch führt Tasks aus | Mensch orchestriert, reviewt, dirigiert Agents |

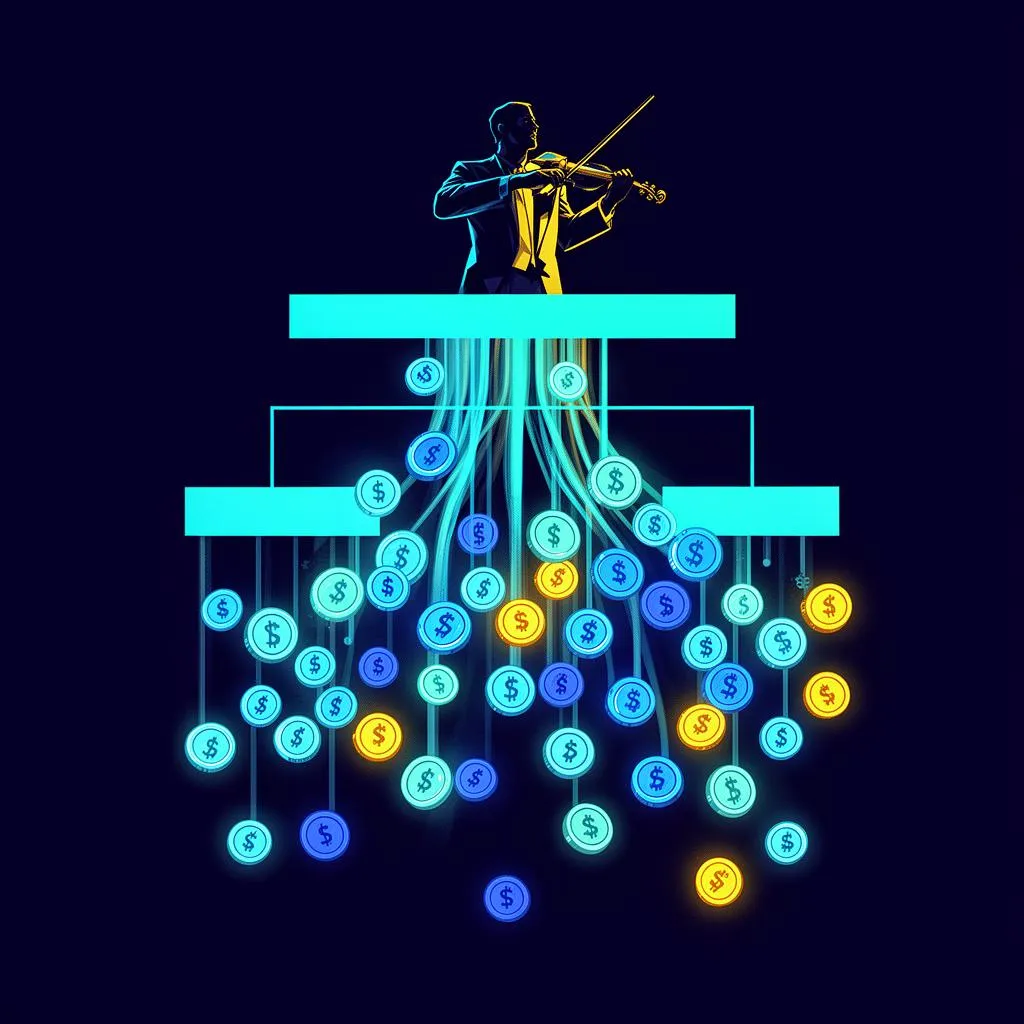

Der letzte Punkt ist der eigentliche Hebel. Wenn dein Team aufhört, Tasks auszuführen, und stattdessen anfängt, Agents zu orchestrieren, wird die Org strukturell etwas anderes. Jeder Mitarbeiter ist effektiv ein Manager. Schnellere Entscheidungen, engere Feedback-Loops, kompoundierender Output.

Was „alles durch das Context-Window" konkret heißt

„Token Maxxing" klingt erstmal abstrakt. Konkret bedeutet es, dass jedes Artefakt im Unternehmen ein potenzieller AI-Input ist – nicht nur das, was offensichtlich „ein Text" ist.

| Artefakt | Wer maxxt es heute schon | Output |

|---|---|---|

| Sales-Calls (Granola, Fathom, Otter) | RevOps, Founder-led-Sales-Teams | Auto-CRM-Updates, Coaching-Notes, Forecast-Signale |

| Verträge & SOWs | Legal Ops, Procurement | Risiko-Flags, Klausel-Diff, Verhandlungsvorbereitung |

| Proposals & RFPs | Solution-Engineering | Erst-Draft in Minuten statt Tagen, Win-Pattern-Analyse |

| Support-Tickets | Customer Success | Kategorisierung, Eskalationsvorhersage, Knowledge-Base-Updates |

| Job-Dokumentation & SOPs | Ops, People | Onboarding-Material, Skill-Gap-Analyse |

| Slack/Teams-Channels | Leadership | Wöchentliche Org-Pulse, Decision-Logs |

| Meeting-Recordings | Alle | Action-Items, automatische Tickets in monday/Linear |

Die Faustregel: Wenn ein Mensch es liest, kann ein Modell es zuerst lesen, klassifizieren, anreichern oder zusammenfassen.

Architektur: Was du dafür brauchst

Token Maxxing ist nicht „mehr ChatGPT-Lizenzen kaufen". Es ist eine kleine, aber konsequente Architektur:

1. Ingestion-Layer

Alles, was reinkommt, muss zu Tokens werden können. Das heißt: Meeting-Recorder, Email-Forwarding-Adressen, Webhook-Endpoints, Datei-Drops in Storage-Buckets, monday-Webhooks, CRM-Events. Jedes Artefakt bekommt einen Pfad ins System.

2. Routing-Layer

Nicht jeder Token gehört in GPT-4o. Eine Klassifikation sortiert nach Komplexität (trivial → Frontier-Reasoning) und Datenschutz (öffentlich → sensibel). Wir haben das hier sauber zerlegt: Model Routing Guide und Privacy Router.

3. Agent-Layer

Wiederholbare Patterns werden zu Agents. Nicht „eine Automation in Make" – sondern ein Agent mit klarer Rolle, Tools, Guardrails und Eval. Wer das ernsthaft baut, sollte unsere Übersicht zu Agent Skills als neuem Industrie-Standard lesen.

4. Orchestration-Layer (der Mensch)

Hier sitzen die Mitarbeiter. Ihr Job: Agents reviewen, korrigieren, neue Patterns identifizieren, Eskalationen entscheiden. Das ist die Arbeit, die in High-AI-Orgs übrig bleibt – und sie ist deutlich höherwertig als „Tickets abarbeiten".

5. Observability

Token-Spend, Latenz, Error-Rates pro Agent. Ohne das fliegst du blind. Wer in dem Bereich gerade aufrüstet, sollte sich AI Agent Ops & Monitoring anschauen.

Token-Ökonomie: Warum das jetzt funktioniert

Der Grund, warum Token Maxxing 2024 noch ökonomischer Wahnsinn gewesen wäre und heute funktioniert, ist trivial:

- Gemini 2.0 Flash bei $0.40 / 1M Output-Tokens

- Claude Haiku bei $4.00 / 1M Output-Tokens

- DeepSeek R1 Reasoning bei $2.19 / 1M Output-Tokens

Du kannst heute eine 100-Seiten-PDF für unter einem Cent klassifizieren. Du kannst ein Sales-Transkript für ~3 Cent voll analysieren. Bei diesen Preisen ist die Frage nicht mehr „lohnt sich das?", sondern „warum machen wir das nicht für alles?".

Wer das nachrechnen will: AI Token Rechner zeigt dir für dein Volumen, was bei welchem Anbieter rauskommt.

Der eigentliche Move: Vom Ausführen zum Orchestrieren

Der harte Teil von Token Maxxing ist nicht die Technik. Es ist die Org-Veränderung dahinter.

Solange dein Team an Tasks gemessen wird – „X Tickets pro Tag", „Y Verträge geprüft", „Z Proposals geschrieben" – wird AI als Bedrohung gelesen. Sobald das Team an Outcomes gemessen wird und Agents die Tasks erledigen, wird AI zum Hebel.

Das ist die Verschiebung, die wir in unserem Agentic Engineering-Artikel beschreiben: Der Mensch typt nicht mehr Code, der Mensch dirigiert Agents, die Code schreiben. Übertrage das auf Sales, Ops, HR, Finance – das ist Token Maxxing in der Org.

In Organisationen, die diesen Schritt gemacht haben, sehen wir konstant:

- 2–4× Output pro Person in den von Agents abgedeckten Prozessen

- Deutlich kürzere Entscheidungs-Zyklen, weil Daten in Echtzeit aufbereitet sind

- Bessere Junior-Onboardings, weil Agents als Pair-Partner fungieren

- Härtere Talent-Magneten, weil die Arbeit für Senior-Talent endlich interessant ist

Wo du anfängst (wenn du bei Null stehst)

Du musst nicht alles auf einmal bauen. Aber du solltest in dieser Reihenfolge starten:

- Inventar machen. Welche fünf Artefakte werden in deiner Org am häufigsten gelesen? (Calls, Tickets, Verträge, Proposals, Reports)

- Eines davon tokenisieren. Bau einen einzigen Pfad: Artefakt → Modell → strukturierter Output → System (CRM, monday, Slack).

- Eval messen. Was war die Qualität ohne AI, was mit? Wo bricht es?

- Agentifizieren. Wenn der Pfad stabil ist, mach ihn zu einem Agent mit Eskalations-Rules an einen Menschen.

- Repeat. Nächstes Artefakt. Nächster Prozess. Nächste Rolle.

Das ist kein 24-Monats-Transformationsprojekt. Das ist ein 4-Wochen-Zyklus, den du immer wieder fährst.

Die Quintessenz

Eric Glyman von Ramp formuliert es so: Das Eis ist gebrochen. Die Frage ist nicht mehr, ob du springst. Die Frage ist, ob du noch nah genug am Rand stehst.

Wir sehen das in jeder Beratung gerade: Der Speed-Gap zwischen Orgs, die ihre Arbeit agentifiziert haben, und denen, die noch manuell prozessieren, wird jedes Quartal größer. Nicht linear. Exponentiell.

Token Maxxing ist nicht die nächste AI-Methode. Es ist die Bedingung dafür, in den nächsten 24 Monaten überhaupt noch operativ wettbewerbsfähig zu sein.

🧮 Was würde Token Maxxing dich kosten? Rechne es durch mit unserem AI Token Rechner – kostenlos, ohne Anmeldung.

🛡️ Wo darf welches Modell deine Daten sehen? Der Privacy Router Guide zeigt das Drei-Zonen-Modell für sensible Daten.

🤖 Du willst Agents bauen, nicht nur Prompts schreiben? Agent Skills als Industrie-Standard erklärt, wohin sich der Markt bewegt.

🏗️ Warum Token Maxxing zum Wertschöpfungs-Leverage wird: Jensen Huangs Five-Layer-Cake & der Application Layer – wo der ökonomische Nutzen wirklich entsteht.

Du willst Token Maxxing in deiner Org einführen, aber nicht bei Null anfangen? Sprich mit uns – wir bauen die ersten Agent-Loops mit dir auf. In Wochen, nicht Quartalen.